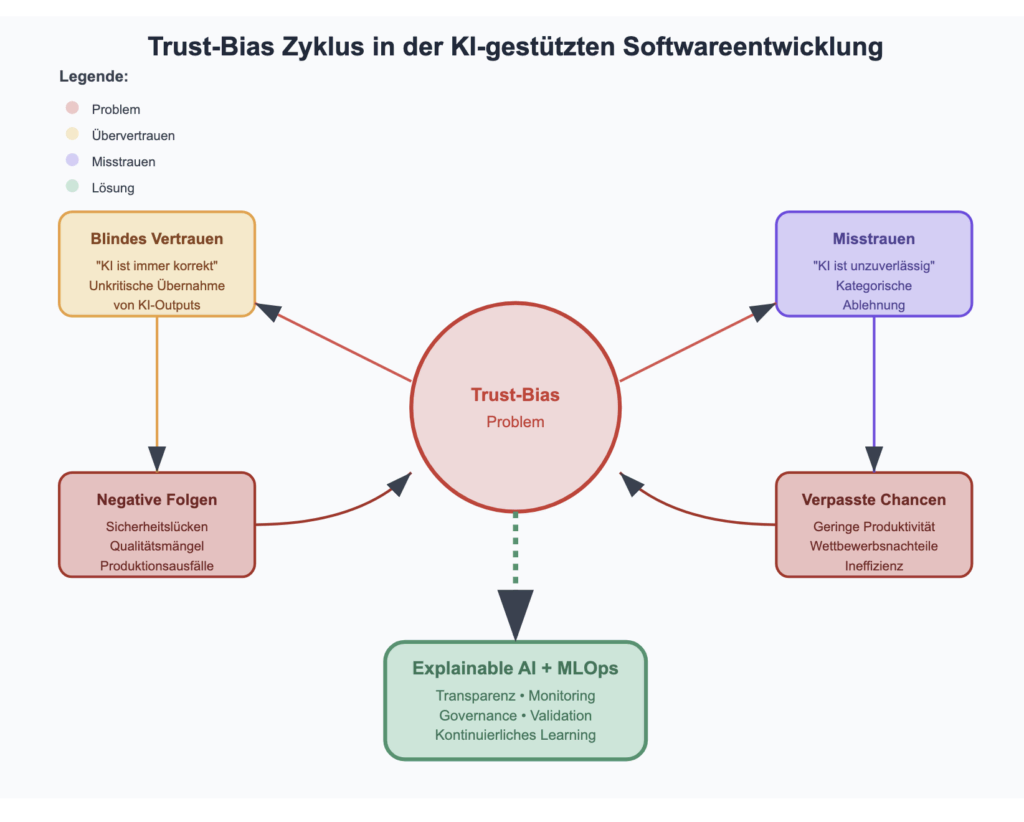

Trust-Bias bezeichnet das Phänomen, bei dem Softwareentwickler und IT-Teams entweder übermäßiges Vertrauen in KI-Systeme entwickeln oder diese grundsätzlich misstrauen, ohne die tatsächlichen Fähigkeiten und Grenzen der Technologie angemessen zu bewerten. Dieser kognitive Verzerrungseffekt stellt eine der größten Herausforderungen für die erfolgreiche Integration von Künstlicher Intelligenz in geschäftskritische Entwicklungsprozesse dar.

Der Trust-Bias manifestiert sich in zwei gegensätzlichen Ausprägungen: Einerseits führt blindes Vertrauen dazu, dass Entwickler KI-generierte Code-Lösungen unkritisch übernehmen, ohne deren Korrektheit oder Sicherheit zu hinterfragen. Andererseits verhindert übermäßiges Misstrauen die Nutzung durchaus verlässlicher KI-Funktionalitäten, wodurch wertvolle Produktivitätssteigerungen in der Softwareentwicklung ungenutzt bleiben.

In der modernen Softwareentwicklung äußert sich dieser Bias besonders problematisch bei Code-Generierung, automatisierten Tests und Deployment-Entscheidungen. Entwickler neigen dazu, KI-generierte Code-Snippets entweder blind zu vertrauen oder kategorisch abzulehnen, anstatt eine sachliche Bewertung basierend auf nachvollziehbaren Kriterien vorzunehmen. Diese polarisierende Haltung führt zu inkonsistenten Qualitätsstandards und gefährdet die Stabilität von Softwareprodukten.

Erklärbare KI (XAI): Transparenz als Fundament für Entwicklervertrauen

Erklärbare Künstliche Intelligenz (Explainable Artificial Intelligence, XAI) adressiert den Trust-Bias durch systematische Transparenz in KI-Entscheidungsprozessen. Diese Technologie macht die oft als „Black Box“ wahrgenommenen Machine Learning-Modelle für Entwickler verständlich und nachvollziehbar. XAI bietet zwei fundamentale Erklärungsansätze: Globale Erklärungen verdeutlichen das generelle Verhalten eines Modells, während lokale Erklärungen spezifische Einzelentscheidungen begründen.

In der Softwareentwicklung ermöglicht XAI-Entwicklern, die Logik hinter KI-generierten Empfehlungen zu verstehen. Wenn ein KI-System beispielsweise Refactoring-Vorschläge macht oder potenzielle Bugs identifiziert, können lokale Erklärungen aufzeigen, welche Code-Patterns oder Metriken zu dieser Bewertung geführt haben. Diese Transparenz befähigt Entwickler, fundierte Entscheidungen über die Übernahme von KI-Vorschlägen zu treffen, anstatt sich von emotionalen Vorurteilen leiten zu lassen.

Die praktische Implementierung von XAI in Entwicklungstools umfasst verschiedene Techniken: LIME (Local Interpretable Model-agnostic Explanations) kann erklären, warum ein Code-Review-System bestimmte Probleme identifiziert hat. SHAP (SHapley Additive exPlanations) verdeutlicht den Beitrag einzelner Code-Eigenschaften zu Qualitätsbewertungen. Attention-Mechanismen in Large Language Models können visualisieren, auf welche Code-Bereiche sich die KI bei der Generierung von Lösungsvorschlägen fokussiert hat.

Die kontinuierliche Überwachung und Verwaltung von Machine Learning-Modellen zur Förderung der KI-Erklärbarkeit wird dabei zu einem kritischen Erfolgsfaktor. Unternehmen müssen die Geschäftsauswirkungen des Einsatzes erklärbarer KI-Algorithmen kontinuierlich messen und bewerten, um das Vertrauen der Entwickler zu stärken und die Modellprüfbarkeit zu gewährleisten.

MLOps-Strategien: Systematisches Vertrauen durch operative Exzellenz aufbauen

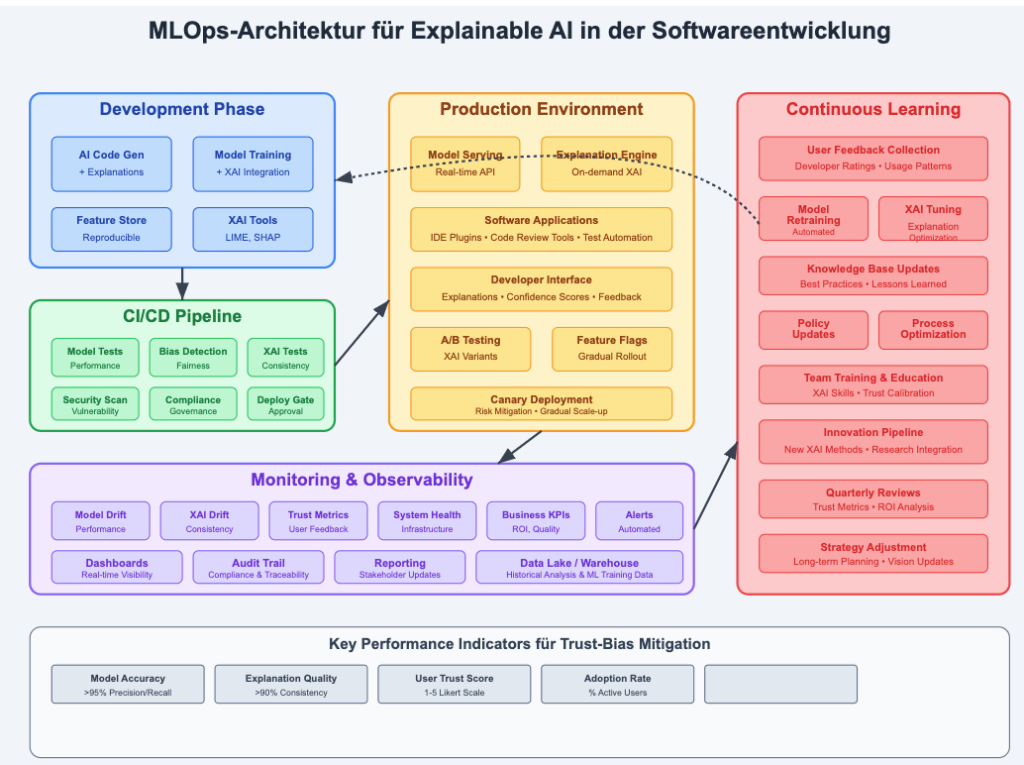

Machine Learning Operations (MLOps) ergänzt Explainable AI durch die Etablierung robuster, transparenter und reproduzierbarer Workflows für den gesamten ML-Lebenszyklus. MLOps adressiert den Trust-Bias nicht nur durch technische Transparenz, sondern durch systematische Qualitätssicherung und Governance-Strukturen, die Vertrauen auf organisatorischer Ebene schaffen.

Die MLOps-Philosophie basiert auf der Automatisierung und Überwachung aller Schritte der ML-Systemkonstruktion, einschließlich Integration, Testing, Releasing, Deployment und Infrastruktur-Management. Diese umfassende Automatisierung reduziert menschliche Fehlerquellen und schafft nachvollziehbare Audit-Trails, die das Vertrauen in KI-Systeme stärken.

In der Softwareentwicklung manifestiert sich MLOps durch kontinuierliche Integration und Deployment (CI/CD) für Machine Learning-Modelle. Tools wie MLflow, Kubeflow oder Azure ML ermöglichen es, Modelle automatisiert zu trainieren, zu validieren und zu deployen. Dabei werden systematisch Metriken zu Modellperformance, Bias-Detection und Drift-Monitoring erfasst. Diese objektiven Daten ersetzen subjektive Einschätzungen und reduzieren den Trust-Bias erheblich.

Besonders relevant für die Softwareentwicklung sind automatisierte Testing-Pipelines für ML-Modelle. Diese umfassen Data Validation, Model Validation und Infrastructure Validation. Wenn beispielsweise ein KI-System zur automatischen Bug-Detection eingesetzt wird, validieren MLOps-Pipelines kontinuierlich dessen Trefferquote, False-Positive-Rate und Performance-Charakteristika. Entwickler können sich auf diese objektiven Metriken verlassen, anstatt auf Bauchgefühl zu vertrauen.

Feature Stores als zentraler Bestandteil von MLOps-Architekturen sorgen für konsistente und wiederverwendbare Feature-Engineering-Prozesse zwischen Training und Produktionsumgebungen. Dies verhindert Training-Serving-Skew und schafft Vertrauen in die Konsistenz der Modellvorhersagen.

Feature Stores – Definition und Rolle Feature Stores sind wichtige, aber nicht zentrale Baustein der MLOps-Architektur zur Vertrauensbildung – sie sind ein technisches Werkzeug, das die Konsistenz und Nachvollziehbarkeit von ML-Systemen unterstützt. Es sind zentrale, verwaltete Repositories für Machine Learning-Features, die als kritischer Baustein moderner MLOps-Architekturen fungieren. Was Feature Stores konkret leisten: 1. Konsistenz zwischen Training und Produktion: Sie stellen sicher, dass die Features, die beim Trainieren des Modells verwendet wurden, identisch mit denen in der Produktionsumgebung sind. 2. Wiederverwendbarkeit: Einmal entwickelte Features können von verschiedenen Teams und Projekten genutzt werden, ohne dass diese das Feature-Engineering neu implementieren müssen. 3. Versionierung: Features werden versioniert und dokumentiert, was Reproduzierbarkeit und Audit-Trails ermöglicht. 4. Training-Serving-Skew Vermeidung: Dies ist ein kritisches Problem, bei dem sich die Datenverteilung zwischen Training und Produktionseinsatz unterscheidet, was zu Performance-Einbußen führt. Praktisches Beispiel in der Softwareentwicklung: Wenn ein KI-System zur automatischen Code-Qualitätsbewertung eingesetzt wird, könnte der Feature Store folgende Features bereitstellen: – Code-Komplexitätsmetriken – Anzahl von Code-Smells – Test-Coverage-Raten – Commit-Frequenz-Patterns Diese Features werden einheitlich für Training, Validierung und Produktionseinsatz verwendet, wodurch die Zuverlässigkeit und das Vertrauen in die KI-Bewertungen gestärkt wird. |

KI-Integration im Entwicklungsumfeld: Die Rolle der Künstlichen Intelligenz im Vertrauensökosystem

Künstliche Intelligenz spielt eine paradoxe Rolle im Kontext des Trust-Bias: Sie ist gleichzeitig Ursache und Lösung des Problems. Moderne KI-Systeme sind so komplex geworden, dass ihre Entscheidungsprozesse für menschliche Nutzer kaum noch nachvollziehbar sind. Gleichzeitig ermöglichen fortschrittliche KI-Technologien jedoch auch die Entwicklung von Werkzeugen zur Erklärbarkeit und Vertrauensbildung.

Generative AI-Modelle wie GPT oder Claude verstärken den Trust-Bias besonders stark, da ihre Outputs oft überzeugend wirken, auch wenn sie faktisch falsch sind. Das Phänomen der „Halluzinationen“ führt zu einer besonderen Form des Trust-Bias, bei der die natürlichsprachige Ausgabe der Modelle unbewusst Autorität suggeriert. In der Softwareentwicklung kann dies zu kritischen Fehlern führen, wenn generierter Code scheinbar korrekt aussieht, aber subtile Bugs oder Sicherheitslücken enthält.

Andererseits ermöglicht KI auch die Entwicklung fortschrittlicher Monitoring- und Validation-Tools. Machine Learning-Systeme können andere ML-Systeme überwachen, Anomalien detektieren und automatische Erklärungen generieren. Diese „KI zur Überwachung von KI“ schafft mehrschichtige Sicherheitsnetze, die das Vertrauen in die Gesamtarchitektur stärken.

Meta-Learning-Ansätze erlauben es KI-Systemen, ihre eigenen Grenzen und Unsicherheiten zu erkennen und zu kommunizieren. Uncertainty Quantification wird dabei zu einem kritischen Feature, das Entwicklern hilft, angemessene Vertrauenslevels zu entwickeln. Wenn ein KI-System explizit kommuniziert, dass es sich bei einer bestimmten Code-Analyse unsicher ist, können Entwickler entsprechend vorsichtig reagieren.

Business IT-Implementierung: Praktische Umsetzung von Explainable AI und MLOps

Die erfolgreiche Integration von Explainable AI und MLOps in Business IT-Umgebungen erfordert einen systematischen Ansatz, der technische, organisatorische und kulturelle Aspekte berücksichtigt. Unternehmen müssen zunächst eine klare Governance-Struktur für KI-Systeme etablieren, die Rollen, Verantwortlichkeiten und Prozesse für den vertrauensvollen Umgang mit KI definiert.

Ein zentraler Baustein ist die Etablierung von AI Ethics Boards und ML Model Governance Committees, die Standards für Modellentwicklung, -validierung und -deployment festlegen. Diese Gremien sollten interdisziplinär besetzt sein und Vertreter aus IT, Business, Compliance und Datenschutz umfassen. Ihre Aufgabe ist es, Richtlinien für explainable AI zu definieren und MLOps-Standards zu etablieren, die den spezifischen Anforderungen des Unternehmens entsprechen.

Die technische Implementierung beginnt mit der Auswahl geeigneter Tools und Plattformen. Moderne MLOps-Plattformen wie MLflow, Weights & Biases oder Azure ML bieten integrierte Explainability-Features, die nahtlos in bestehende Entwicklungsworkflows integriert werden können. Diese Tools ermöglichen es, Modellinterpretation als Standard-Bestandteil des Development Lifecycle zu etablieren, anstatt sie als nachgelagerten Schritt zu betrachten.

Für Softwareentwicklungsteams bedeutet dies konkret die Integration von Explainability-Checks in Code-Review-Prozesse. Wenn KI-Tools Code-Änderungen vorschlagen, müssen diese nicht nur auf funktionale Korrektheit, sondern auch auf die Nachvollziehbarkeit der KI-Entscheidung geprüft werden. Automatisierte Tests sollten nicht nur die technische Funktionalität, sondern auch die Konsistenz der KI-Erklärungen validieren.

Die Schulung und Change Management spielen eine entscheidende Rolle bei der Überwindung des Trust-Bias. Entwickler müssen lernen, KI-Systeme weder blind zu vertrauen noch kategorisch abzulehnen, sondern sie als Werkzeuge zu verstehen, deren Outputs kritisch bewertet werden müssen. Dies erfordert sowohl technische Schulungen zu Explainable AI-Techniken als auch die Entwicklung kritischer Denkfähigkeiten im Umgang mit KI-generierten Inhalten.

KI-Monitoring und Continuous Improvement: Langfristige Vertrauensbildung sicherstellen

Die Überwindung des Trust-Bias ist kein einmaliger Akt, sondern ein kontinuierlicher Prozess, der systematisches Monitoring und ständige Verbesserung erfordert. MLOps-Systeme müssen daher umfassende Observability-Features bieten, die nicht nur technische Metriken, sondern auch vertrauensrelevante Indikatoren erfassen.

Key Performance Indicators (KPIs) für Vertrauen umfassen Metriken wie Model Drift, Prediction Confidence, Explanation Consistency und User Acceptance Rates. Diese Metriken müssen kontinuierlich überwacht und in Dashboards visualisiert werden, die sowohl technischen Teams als auch Business Stakeholdern verständlich sind. Wenn beispielsweise die Explanation Consistency eines Code-Review-Systems abnimmt, deutet dies auf potenzielle Vertrauensprobleme hin, die proaktiv adressiert werden müssen.

Feedback-Loops zwischen menschlichen Nutzern und KI-Systemen sind essentiell für die kontinuierliche Verbesserung der Vertrauensbeziehung. Entwickler sollten einfache Mechanismen haben, um KI-Entscheidungen zu bewerten und Feedback zu geben. Dieses Feedback kann dann zur Verbesserung der Explainability-Algorithmen und zur Anpassung der MLOps-Pipelines genutzt werden.

A/B-Testing von verschiedenen Explainability-Ansätzen ermöglicht es, empirisch zu validieren, welche Erklärungsformen das Vertrauen am effektivsten stärken. Verschiedene Entwicklergruppen können mit unterschiedlichen Explanation-Interfaces arbeiten, und deren Vertrauen sowie Produktivität kann gemessen und verglichen werden.

Implementierungsherausforderungen: Grenzen und Lösungsansätze bei erklärbarer KI

Trotz der vielversprechenden Ansätze von Explainable AI und MLOps bleiben signifikante Herausforderungen bei der Überwindung des Trust-Bias bestehen. Eine fundamentale Limitation liegt in der inhärenten Komplexität moderner KI-Systeme. Deep Learning-Modelle mit Millionen oder Milliarden von Parametern lassen sich nicht vollständig in menschlich verständliche Regeln übersetzen, ohne dabei wesentliche Informationen zu verlieren.

Die Qualität von Erklärungen ist oft schwer zu bewerten. Eine Erklärung kann intuitiv verständlich sein, aber dennoch die tatsächlichen Entscheidungsmechanismen des Modells nicht korrekt repräsentieren. Diese „Illusion der Verständlichkeit“ kann zu einer falschen Vertrauensbildung führen und den Trust-Bias verstärken, anstatt ihn zu reduzieren. Entwickler müssen daher lernen, nicht nur die Erklärungen selbst, sondern auch deren Zuverlässigkeit kritisch zu hinterfragen.

Die Performance-Transparenz-Trade-offs stellen eine weitere Herausforderung dar. Oft korrelieren Modellkomplexität und Vorhersagegenauigkeit positiv, während die Interpretierbarkeit negativ korreliert. Unternehmen müssen daher bewusste Entscheidungen über das akzeptable Maß an Transparenz treffen und diese Entscheidungen klar kommunizieren.

Regulatorische Anforderungen variieren stark zwischen Branchen und Regionen, was die Entwicklung einheitlicher Explainability-Standards erschwert. Während beispielsweise im Finanzsektor strenge Nachweispflichten für automatisierte Entscheidungen bestehen, sind die Anforderungen in anderen Bereichen der Softwareentwicklung oft unklarer.

Zukunftstrends XAI und MLOps: Technologieentwicklung und regulatorische Rahmenbedingungen

Die Weiterentwicklung von Explainable AI und MLOps wird maßgeblich durch aufkommende Technologien und veränderte regulatorische Rahmenbedingungen geprägt. Large Language Models entwickeln sich zunehmend in Richtung natürlichsprachiger Erklärungen, die technische und nicht-technische Stakeholder gleichermaßen ansprechen können. Diese „Conversational Explainability“ könnte den Trust-Bias reduzieren, indem sie komplexe Modellentscheidungen in verständliche Dialoge übersetzt.

Automated Machine Learning (AutoML) integriert zunehmend Explainability-Features als Standard-Komponenten. Zukünftige AutoML-Systeme werden nicht nur optimale Modellarchitekturen auswählen, sondern auch die bestmöglichen Erklärungsstrategien für spezifische Anwendungsfälle identifizieren. Dies demokratisiert den Zugang zu erklärbarer KI und reduziert die Barrieren für deren Implementierung in kleineren Entwicklungsteams.

Föderterte Lernansätze (Federated Learning) stellen neue Herausforderungen und Chancen für Explainable AI dar. Wenn Modelle auf verteilten Daten trainiert werden, ohne dass diese zentral gesammelt werden, müssen auch die Erklärungsalgorithmen föderierte Ansätze unterstützen. Dies eröffnet neue Möglichkeiten für privacy-preserving Explainability, birgt aber auch Komplexitäten für das Vertrauensmanagement.

Die Integration von Blockchain-Technologien in MLOps-Pipelines könnte unveränderliche Audit-Trails für KI-Entscheidungen schaffen und damit das Vertrauen in die Integrität von Explanations stärken. Smart Contracts könnten automatisch Governance-Regeln für Modelldeployment durchsetzen und sicherstellen, dass nur ausreichend erklärbare Modelle in Produktion gehen.

Fazit: Erfolgsfaktoren für vertrauenswürdige KI-Integration in Entwicklungsteams

Die Überwindung des Trust-Bias in der KI-gestützten Softwareentwicklung erfordert einen holistischen Ansatz, der technische Lösungen, organisatorische Prozesse und kulturellen Wandel gleichermaßen umfasst. Explainable AI und MLOps bieten die notwendigen Werkzeuge und Methodiken, aber deren erfolgreiche Implementierung hängt entscheidend von der strategischen Vision und dem Commitment der Organisation ab.

Unternehmen, die den Trust-Bias erfolgreich überwinden, werden signifikante Wettbewerbsvorteile realisieren können. Sie werden KI-Technologien effektiver nutzen, weil ihre Entwickler fundierte Entscheidungen über deren Einsatz treffen können. Gleichzeitig werden sie Risiken besser managen, weil sie die Grenzen und Unsicherheiten ihrer KI-Systeme verstehen und kommunizieren können.

Der Weg zu vertrauenswürdiger KI in der Softwareentwicklung ist komplex und erfordert kontinuierliche Anpassung an neue Technologien und sich verändernde Anforderungen. Organisationen, die diesen Weg konsequent verfolgen, werden jedoch in der Lage sein, das volle Potenzial der Künstlichen Intelligenz zu erschließen, während sie gleichzeitig die Risiken minimieren und das Vertrauen aller Stakeholder stärken.