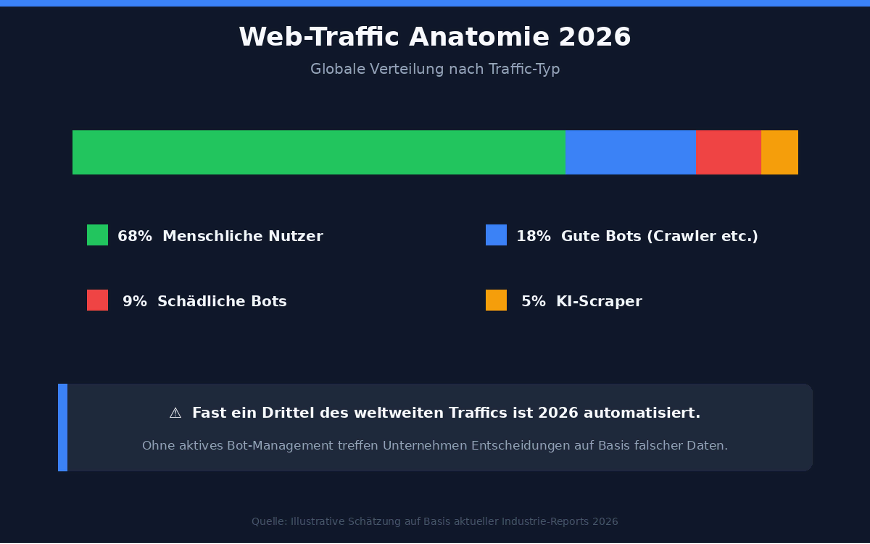

Lange Zeit war die Unterscheidung in der IT-Welt simpel: Es gab menschliche Nutzer und es gab Suchmaschinen-Crawler, also harmlose Bots. Doch die aktuelle Datenlage zeigt ein völlig neues Bild.

Im Jahr 2026 ist fast ein Drittel des weltweiten Web-Traffics automatisiert – und die Grenzen zwischen nützlichen Bots und ernsthaften Bedrohungen verschwimmen zusehends. Für Unternehmen bedeutet das: Bot-Management ist längst kein reines IT-Sicherheitsthema mehr, sondern eine geschäftskritische Strategie, die Marketing, Finanzen und Recht gleichermaßen betrifft.

Fast ein Drittel des weltweiten Traffics ist 2026 automatisiert. Wer Bots gewähren lässt, verliert die Hoheit über seine Daten, seine Kosten und letztlich seine Wettbewerbsfähigkeit.

Die neue Anatomie des Web-Traffics

Die Bedrohungslandschaft hat sich fundamental gewandelt: Einfache Skripte, die noch vor einigen Jahren die Bot-Welt dominierten, sind längst von hochkomplexen, KI-gestützten Systemen abgelöst worden. Moderne Angreifer sind kaum noch von echten Nutzern zu unterscheiden. Ein Umstand, der traditionelle Abwehrmechanismen zunehmend ineffektiv macht.

KI-Crawler und der gestörte Value Exchange

Große Sprachmodelle (LLMs) wie ChatGPT, Gemini oder Perplexity benötigen kontinuierlich frische Daten, um ihre Antwortqualität zu erhalten. Ihre Crawler durchforsten das Web mit einer Intensität und Frequenz, die klassische Suchmaschinen-Bots weit übertrifft. Das eigentliche Problem liegt jedoch tiefer: Während Google-Traffic früher Nutzer aktiv auf Webseiten leitete und so Werbeeinnahmen generierte, liefern KI-Systeme die Antwort heute direkt im Chat-Interface aus. Das sogenannte Zero-Click-Phänomen zerstört das werbebasierte Geschäftsmodell vieler Publisher. Unternehmen tragen die Serverlast und Infrastrukturkosten der Datenabfragen, erhalten dafür aber keinen messbaren Return mehr in Form von Website-Traffic oder Conversions.

Headless Bots: Geisterfahrer im Browser

Eine noch gefährlichere Kategorie sind sogenannte Headless Bots. Diese nutzen vollständige Browser-Engines wie Chromium, führen JavaScript korrekt aus, simulieren Maus- und Tastatureingaben und hinterlassen nahezu identische Browser-Fingerprints wie menschliche Nutzer. Ihre Einsatzgebiete sind vielfältig und wirtschaftlich schädlich: Im E-Commerce reservieren sie durch Inventory Hoarding Produkte aus den Warenkörben, ohne diese zu kaufen. Ein taktischer Angriff auf Konkurrenten, der zu künstlichen Engpässen führt.

Über Credential Stuffing testen sie systematisch gestohlene Login-Daten-Kombinationen aus öffentlichen Datenlecks. Und durch Real-Time-Price-Monitoring ermöglichen sie Mitbewerbern eine sekundengenaue Preissynchronisation, die faire Wettbewerbsbedingungen untergräbt.

✅ Checkliste: Metriken zur Bot-Identifizierung

✅ Bot-Traffic Anteil an den Gesamt-Requests (Monitoring von User-Agent-Strings)

✅Anteil der ‚Zero-Click‘ Sessions in der Web-Analyse (Referral Traffic Trends)

✅Fehlgeschlagene Login-Versuche pro Minute (Indiz für Credential Stuffing)

✅CPU-Auslastung und Bandbreitenkosten im Verhältnis zum tatsächlichen Umsatz

✅Verhältnis von GET- zu POST-Requests (Auffällige Muster bei automatisiertem Scraping)

Die Konsequenzen unkontrollierten Bot-Traffics sind vielschichtig und betreffen weit mehr als die IT-Abteilung. Sie reichen von finanziellen Verlusten bis hin zu strategischen Fehlentscheidungen auf Führungsebene.

- Erosion der Gewinnmarge: Im E-Commerce werden Marketing-Budgets für Fake-Traffic verbrannt. Pay-per-Click-Kampagnen generieren Kosten ohne reale Kaufabsicht dahinter, während die Conversion-Rate künstlich sinkt und Optimierungsentscheidungen verzerrt.

- Infrastruktur-Burnout: Ein massiver Anstieg an Bot-Anfragen treibt Cloud- und CDN-Kosten (Content Delivery Network) in die Höhe, ohne einen Cent Umsatz zu generieren. In Spitzenzeiten kann böswilliger Bot-Traffic gezielt eingesetzt werden, um Infrastruktur unter Last zum Erliegen zu bringen (DDoS-ähnliche Wirkung).

- Strategische Blindheit: Wenn 30 bis 40 Prozent der Daten in der Web-Analyse von Bots stammen, treffen Geschäftsführungen ihre Entscheidungen auf Basis falscher Annahmen über Nutzerverhalten, Seitenperformance und Kampagnenerfolg. Auch A/B-Tests und UX-Optimierungen werden durch verseuchte Datenpools wertlos.

- Reputationsrisiko durch Account-Takeover: Erfolgreiche Credential-Stuffing-Angriffe führen zu kompromittierten Kundenkonten. Die daraus resultierenden Datenschutzverletzungen können unter der DSGVO empfindliche Bußgelder und einen erheblichen Vertrauensverlust nach sich ziehen.

Gefahren und Gegenmaßnahmen im Bot-Management

| Gefahr | Auswirkung | Strategische Gegenmaßnahme |

| Credential Stuffing | Kontenübernahmen (Account Takeover), Identitätsdiebstahl. | Multi-Faktor-Authentisierung (MFA) & Analyse von Verhaltensbiometrie. |

| Content Scraping (KI) | Verlust von IP/Content, sinkender Referral-Traffic, SEO-Schaden. | Dynamisches Rate Limiting & Anpassung der robots.txt für KI-User-Agents. |

| Inventory Hoarding | Blockierte Warenkörbe, entgangene Umsätze im E-Commerce. | Kurze Time-to-Live (TTL) für Warenkörbe & Headless-Browser-Erkennung. |

| Preis-Spionage | Wettbewerber unterbieten Preise in Echtzeit. | Täuschung durch „Honey Pot“-Daten oder verzögerte Preisaktualisierung für Bots. |

| Ad Fraud | Verschwendung von Marketing-Budget durch Klick-Bots. | IP-Reputationsfilter & Integration von Anti-Fraud-Tools in die Ad-Pipeline. |

| DDoS-Angriffe | Überlastung der Server, Downtime der Dienste. | Web Application Firewall (WAF) & Cloud-basierte DDoS-Mitigation am Edge. |

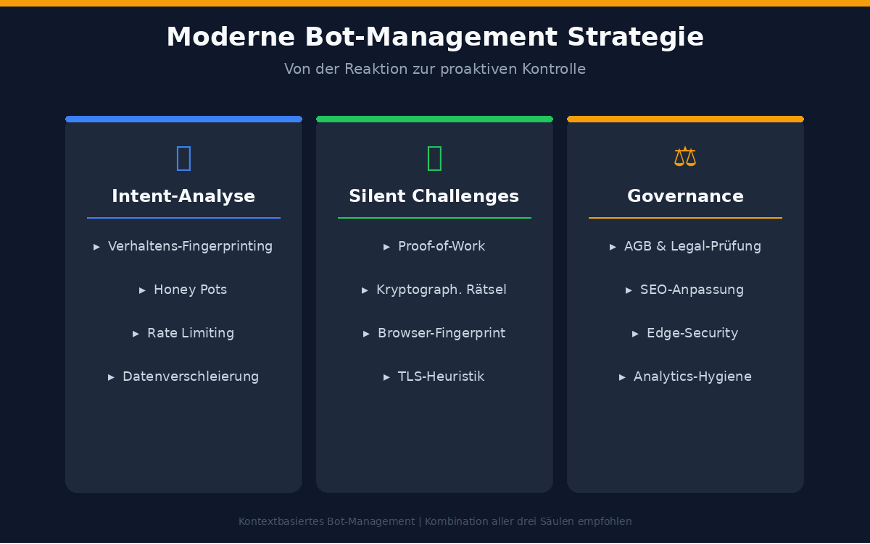

Wege aus der Automatisierungsfalle

Ein moderner Schutzschirm kann nicht mehr binär funktionieren. Das schlichte Blockieren oder Zulassen von Traffic nach starren IP-Listen ist 2026 obsolet. Gefragt ist ein kontextbasiertes, dynamisches Bot-Management, das gute von schlechten Bots unterscheidet und entsprechend reagiert.

1. Dynamisches Intent-Management und Verhaltensanalyse

Statt statische IP-Blacklists zu pflegen, müssen moderne Systeme das Verhalten in Echtzeit analysieren. Bewegt sich die Maus zu gleichmäßig? Werden Formulare zu schnell ausgefüllt? Interagiert der Client mit unsichtbaren Honey-Pot-Feldern? Ein intelligentes System lernt kontinuierlich, erstellt Verhaltens-Fingerprints und reagiert differenziert: Es lässt den hilfreichen Partner-Bot passieren, drosselt den aggressiven KI-Scraper via Rate Limiting oder füttert ihn gezielt mit leicht veränderten, unbrauchbaren Daten. Zusätzlich ermöglicht Browser-Fingerprinting die Analyse von Canvas-Rendering, WebGL-Eigenschaften und installierten Plugins, um Headless-Browser zuverlässig zu identifizieren.

2. Proof-of-Work und Silent Challenges statt CAPTCHA

Die klassischen Klicken Sie alle Ampeln an-Tests sind für moderne KI-Bots kaum noch ein Hindernis, frustrieren jedoch menschliche Kunden und schaden der User Experience. KI-gestützte Bilderkennungs-Dienste lösen visuelle CAPTCHAs heute mit Trefferquoten von über 95 Prozent, schneller als ein Mensch. Moderne Ansätze setzen daher auf kryptografische Challenges im Hintergrund. Das Gerät des Nutzers löst automatisch eine komplexe Rechenaufgabe (Proof-of-Work). Für einen einzelnen Menschen auf einem normalen Gerät läuft dieser Prozess unbemerkt in Millisekunden ab. Für eine Bot-Farm, die Millionen von Anfragen pro Minute senden muss, wird diese Rechenleistung zu einem massiven Kostenfaktor, der den Angriff schlicht unwirtschaftlich macht.

3. Edge-Security als erste Verteidigungslinie

Schädlicher Traffic sollte idealerweise bereits am Edge, also an den Eintrittspunkten des Netzwerks bei CDN-Anbietern wie Cloudflare, Fastly oder Akamai, erkannt und geblockt werden, bevor er überhaupt die teuren Origin-Server erreicht. Dies reduziert nicht nur Sicherheitsrisiken, sondern senkt auch direkt die Infrastrukturkosten. Moderne Web Application Firewalls (WAFs) mit integrierter Bot-Erkennung sind dabei unverzichtbar.

4. Die Allianz aus Marketing, Security und Legal

Bot-Management ist eine Querschnittsaufgabe. Das Legal-Team sollte die Allgemeinen Geschäftsbedingungen auf das Thema Scraping durch KI-Anbieter prüfen und gegebenenfalls explizite Verbote sowie Abmahnmechanismen einbauen. Das Marketing-Team muss seine SEO-Strategie auf eine Welt ausrichten, in der Zero-Click-Searches dominieren – etwa durch verstärktes Setzen auf Brand-Authority, strukturierte Daten (Schema.org) und direkte Nutzerbeziehungen über Newsletter und Communities. Die IT implementiert die technischen Maßnahmen, führt aber auch regelmäßige Analytics-Hygiene durch, um Bot-Traffic aus Reporting-Daten zu bereinigen.

Fazit: Kontrolle ist die neue Währung

Wir befinden uns in einer Ära, in der die Kontrolle über den eigenen Traffic direkt über die Wettbewerbsfähigkeit entscheidet. Bots werden nicht verschwinden: im Gegenteil, mit der zunehmenden Verbreitung von KI-Agenten und automatisierten Workflows wird ihr Anteil weiter steigen. Wer Bots gewähren lässt, verliert die Hoheit über seine Daten, seine Kosten und seine strategischen Entscheidungsgrundlagen. Wer sie jedoch intelligent steuert, schützt nicht nur seine Ressourcen, sondern sichert sich eine saubere, verlässliche Datenbasis für zukünftige Geschäftsentscheidungen, und einen klaren Wettbewerbsvorteil in einer zunehmend automatisierten digitalen Wirtschaft.

Der entscheidende Paradigmenwechsel: Von der reaktiven Bot-Blockade zur proaktiven Traffic-Steuerung. Nicht jeder Bot ist ein Feind – aber jeder Bot muss bewusst zugelassen oder abgewiesen werden.

Weitere Informationen finden Sie im Fastly Threat Insights Report.

Q & A: Bot-Traffic & Unternehmensstrategie

Warum reicht ein einfaches Blockieren von Bots heute nicht mehr aus?

Weil moderne Bots (Headless Browser) legitimes Nutzerverhalten nahezu perfekt simulieren – inklusive JavaScript-Ausführung, realistischer Mausbewegungen und korrekter Browser-Fingerprints. Zudem sind manche Bots ausdrücklich erwünscht, etwa Partner-APIs oder Suchmaschinen-Crawler. Ein pauschales Blockieren würde wichtige Geschäftsprozesse unterbrechen und die User Experience echter Kunden durch übermäßige Sicherheitsabfragen massiv verschlechtern.

Was ist die größte Gefahr durch KI-Crawler für Publisher und Medienhäuser?

Das sogenannte Zero-Click-Phänomen. KI-Systeme extrahieren die wertvollsten Informationen einer Webseite, um sie direkt im Chat-Interface anzuzeigen. Der Nutzer muss die Ursprungsseite nicht mehr besuchen. Das zerstört das werbebasierte Geschäftsmodell vieler Medienhäuser fundamental – ohne dass es dafür bisher eine adäquate Kompensation gibt. Erste Verlage reagieren mit robots.txt-Anpassungen, dem Sperren spezifischer Crawler-User-Agents oder mit Lizenzvereinbarungen mit KI-Anbietern.

Wie erkenne ich, ob mein Unternehmen unter schädlichem Bot-Traffic leidet?

Typische Warnsignale sind: unerklärliche Spitzen in den Server- und CDN-Kosten, eine ungewöhnlich hohe Bounce-Rate bei gleichzeitig extrem kurzer Session-Dauer, eine Häufung von Login-Fehlern oder Warenkorb-Abbrüchen ohne Korrelation zu Marketing-Aktivitäten sowie auffällig gleichmäßige Traffic-Muster zu unüblichen Zeiten. Eine Traffic-Segmentierung nach User-Agent und Verhaltensmerkmalen in der Web-Analyse gibt schnell Aufschluss.

Sind CAPTCHAs im Jahr 2026 noch zeitgemäß?

Kaum. KI-gesteuerte Bots lösen visuelle Rätsel heute mit einer Erfolgsquote von über 95 Prozent – oft schneller als Menschen. Der Trend geht klar zu Silent Challenges wie dem Proof-of-Work, bei dem der Browser im Hintergrund eine kryptografische Aufgabe löst, ohne den Nutzer zu stören. Ergänzend kommen verhaltensbasierte Risikomodelle zum Einsatz, die nur bei konkretem Verdacht eine explizite Nutzerinteraktion einfordern.

Welche rechtlichen Möglichkeiten haben Unternehmen gegen unerwünschtes Scraping?

Unternehmen können erstens das Scraping-Verbot explizit in ihren AGB verankern und bei Verstößen abmahnen oder auf Unterlassung klagen. Zweitens schützt das Datenbankherstellerrecht (§ 87a UrhG) strukturierte Datenbanken bei nachgewiesener substanzieller Investition. Drittens kann eine technische robots.txt-Direktive zwar rechtlich nicht direkt einklagbar sein, signalisiert aber den rechtlichen Willen. Für KI-spezifisches Scraping gibt es aktuell noch wenig etablierte Rechtsprechung – das Thema entwickelt sich jedoch dynamisch.