Edge oder Fog Computing gehörte im nun bald vergangenen Jahr zu den wohl am meisten diskutierten und genannten IT-Themen. Edge, das bedeutet die Verschiebung der Rechenleistung von einer zentralen Stelle, zum Beispiel einem Hyperscale-Rechenzentrum, in eine dezentrale oder mehrstufige Architektur mit verteilten Access Points.

Edge oder Fog Computing gehörte im nun bald vergangenen Jahr zu den wohl am meisten diskutierten und genannten IT-Themen. Edge, das bedeutet die Verschiebung der Rechenleistung von einer zentralen Stelle, zum Beispiel einem Hyperscale-Rechenzentrum, in eine dezentrale oder mehrstufige Architektur mit verteilten Access Points.

Diese Entwicklung wird sich aus diversen Gründen auch in Zukunft weiter durchsetzen und damit die Verlagerung in die Cloud ergänzen. Doch was beeinflusst die Verlagerung von Infrastrukturen hin an den „Rand des Internets“ mit Mikro-Rechenzentren direkt vor Ort und welche Faktoren treiben den Trend Edge-Computing an?

Das Internet of Things als Haupttreiber

Der wichtigste Treiber für Edge Computing ist das rapide wachsende Internet of Things (IoT) und der damit verbundene enorme Anstieg an Datenmengen. Smart Grid, Smart Cities, autonomes Fahren, Industrie 4.0, also die Vernetzung von Sensoren und Geräten bzw. Maschinen, tragen ihren Teil dazu bei, dass sehr große Datenmengen in Echtzeit verarbeitet und lokal in Aktionen umgesetzt werden müssen. Das stellt vor allem Cloud- und Content-Service-Betreiber vor eine entscheidende Herausforderung: nach wie vor einen kontinuierlich guten Service bzw. eine hohe Verfügbarkeit mit kurzen Antwortzeiten zu gewährleisten. Die Folge ist, dass der Transport von Daten teurer und Latenzzeiten länger werden. Beim Edge Computing werden große Datenmengen dezentral nahe am Nutzer verarbeitet. So werden die Netzwerke weniger belastet als bei der ausschließlichen Verarbeitung in großen zentralen Rechenzentren. Eine sinnvolle Alternative für Großunternehmen, Content- und Cloud-Anbieter ist daher die mehrstufige Architektur aus zentralen “Hyperscale”-Zentren, lokalen (2nd Tier) Rechenzentren und sehr kleinen Internet Zugangspunkten. So wird zum Beispiel im Rahmen von Connected Car-Initiativen bereits in Mobilfunk-Basisstationen Rechen- bzw. Speicherleistung aufgebaut.

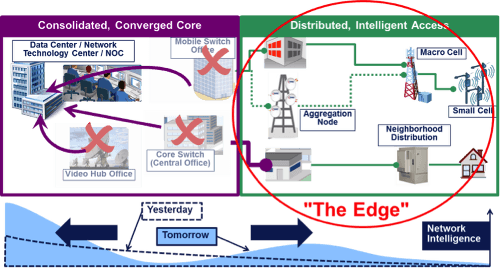

Bild 1: Rechenleistung bewegt sich zum Kern und zum Rand. Quelle: Vertiv

Edge Computing unterstützt Datensicherheit und Verfügbarkeit

Ein weiterer elementarer Aspekt ist die Sicherheit. Edge Computing kann dazu beitragen, die Ausfallsicherheit von Unternehmensinfrastrukturen zu verbessern. Viele Unternehmen sind mit mehreren Standorten in verschiedenen Ländern oder Städten vertreten. Wenn in Netzwerken mit zentralen Rechenzentren IT-Infrastruktur ausfällt, kann das den Betrieb an allen Standorten erheblich beeinträchtigen – bis hin zu ernsthaften Auswirkungen auf Umsatzziele und den Ruf des Unternehmens. Durch die Verlagerung von Teilressourcen in die Randbereiche des Netzwerks lässt sich der Betrieb an entfernten Standorten selbst bei einem Ausfall im Kernbereich aufrechterhalten. Verschiedene teilweise isolierte Netzwerke können bei Ausfall der WAN Verbindung gegebenenfalls separat betrieben werden. Auch die Sicherung von Daten spielt eine entscheidende Rolle, damit im Falle eines Datenverlusts Geschäftsdaten schnellwiederhergestellt werden können.

Neben der Ausfallsicherheit spielt auch die Sicherheit geschäftskritischer Daten eine große Rolle. Die Speicherung und Verarbeitung von Informationen am Ort des Geschehens ist gerade für Branchen wie das Gesundheitswesen, das Finanzwesen und den Einzelhandel eine Möglichkeit, sensible Daten „bei sich zu behalten“ und sie damit zu schützen. Einfache Geräte hinter dem Netzwerkrand sind meist weniger anfällig für Sicherheitsbedrohungen. Andererseits bietet eine verteilte IT-Infrastruktur oft mehr Geräte und Zugangspunkte und damit auch mehr Angriffsfläche. Der Schutz der Endpunkte ist daher beim Edge Computing sehr wichtig. Vor allem Filialisten setzen häufig auf eine Kombination zentraler Rechenzentren und lokaler Datenverarbeitung in Form von Server- oder Netzwerkräumen. Unabhängig davon, wo sich die Geräte und Daten befinden, sollten IT Abteilungen in der Lage sein, Sicherheitsbedrohungen rechtzeitig zu erkennen und das System als Ganzes abzuschotten.

Edge Computing schafft Mehrwert für Kunden

In einer Zeit, in der Speichervolumina, Datenbankoptimierung und die Abfrage großer Datenmengen zu den vorrangigen Themen gehören, tun sich viele Unternehmen schwer damit, Investitionen in Technik und Technologien in einen Mehrwert für ihre Kunden und das Unternehmen selbst umzuwandeln. Mit Edge Computing entfällt die Übertragung von Daten an ein zentrales Rechenzentrum und damit das Risiko von Verzögerungen beim Empfang und der Verarbeitung der Daten. Solche Verzögerungen erweisen sich insbesondere dann als kontraproduktiv, wenn Kunden die Bereitstellung von Applikationen in Echtzeit erwarten. Indem die IT-Ressourcen in die Randbereiche des Netzwerks verschoben werden, können viele Anwendungen dort in Echtzeit ausgeführt werden. Dazu gehören etwa Apps für Zahlungstransaktionen, zur Anzeige von Produktkatalogen oder zur Bereitstellung von Inhalten. Die Bereitstellungsstrategie von Netflix ist beispielsweise stark auf das Konzept von Edge Computing ausgerichtet. Archive werden so nah wie möglich am Endbenutzer gehostet, um ihm die qualitativ bestmögliche Streaming-Erfahrung zu bieten.

Edge Computing versetzt Unternehmen außerdem in die Lage, Daten schneller analysieren zu können. Daten geben Einblicke in Marktrends und Kundenverhalten – und sind damit Lebenselexier fast jeden Unternehmens in Zeiten, da es auf standortbasierte Dienste und personalisierte Inhalte ankommt. Daten sind jedoch nur so lange von Wert, wie sie aktuell sind. Wird die Datenanalyse in die Randbereiche des Unternehmensnetzes verschoben, lassen sich ohne Latenzzeiten und Bandbreitenprobleme nützliche Einblicke gewinnen.

Edge Heating: Energy Recycling vor Ort

Durch den Anstieg der mobilen Endgeräte und dem Datenverkehr im IoT steigt auch der Stromverbrauch für Betrieb und Produktion von Consumer Devices, Netzwerk Infrastrukturen und Rechenzentren massiv an. Aktuelle Untersuchungen gehen davon aus, dass im Jahr 2030 bis zu 50 Prozent des Weltstroms allein dafür aufgewendet werden müssen. Dieses Szenario gilt für den Fall, dass die Datenmengen wie bisher ansteigen und bei der Energieeffizienz keine Fortschritte erzielt werden. Es besteht also Handlungsbedarf. Da der gesamte verbrauchte Strom letztlich immer in Wärme umgewandelt wird, gilt es Wege zu finden, diese weiterzuverwenden statt sie in die Atmosphäre zu blasen. Edge Computing kann auch hierzu einen Beitrag leisten, zum Beispiel durch die Wärmerückgewinnung vor Ort. Unternehmen, die lokale Serverräume betreiben, könnten die abgegebene Wärme nutzen, um ihre Räumlichkeiten zu heizen. Für Rechenzentren gibt es bereits eindeutig definierte Werte wie den Energy Reuse Factor (ERF), der aufzeigt, welcher Anteil des Gesamtenergieverbrauchs durch Eigenproduktion von Wärme zurückgewonnen wurde. In einigen europäischen Ländern wird die Abwärme von Rechenzentren bereits genutzt und in Fernwärmenetze eingespeist. Da eine Fernwärmeversorgung in Deutschland noch wenig verbreitet ist, bleibt auch die Abwärme von Rechenzentren bisher in der Regel ungenutzt. Der Weg über Edge Computing wäre unabhängig von einem Heizungsnetz und würde die Nutzung der Abwärme direkt vor Ort – in Form von Edge Heating – ermöglichen.

Das Mikro-Rechenzentrum auf dem Vormarsch

So vielversprechend Edge Computing auch ist, einige kleine Wermutstropfen gibt es doch. Bei der Verteilung von IT-Infrastrukturen auf verschiedene kleinere Standorte sind hohe Verfügbarkeit, Energieeffizienz und physische Sicherheit mit deutlich höheren Kosten verbunden als bei einem Großrechenzentrum vergleichbarerer Leistung. Außerdem sind Edge Computing Kapazitäten schlechter skalierbar, daher muss mehr Überkapazität vorgehalten werden. Zusätzlich ist die Wartung aufwändiger. Es geht also bei der Entscheidung für oder gegen Edge Computing immer darum, die richtige Balance zwischen Mehraufwand und Nutzen zu finden. Mikro-Rechenzentren, auch Datacenter-in-a-Box genannt, helfen Unternehmen dabei, den Vorteil großer Rechenzentren mit dem Edge Computing zu kombinieren. Sie integrieren alle relevanten Schutzmaßnahmen in einem oder mehreren Racks. Dazu gehören Kühlung, USV-Lösung, Zugangssicherung und Brandschutz, aber auch die Möglichkeit die Assets durch Remote oder Date Center Infrastructure Management (DCIM) zu überwachen, zu steuern und zu warten. Der Trend zur Dezentralisierung bietet eine enorme Chance, die vorhandenen IT-Infrastrukturen, zentral und dezentral, genauer unter die Lupe zu nehmen und sie hinsichtlich Aktualität, Compliance, Energieeffizienz und Sicherheit zu überprüfen.

Bild 2: Das Mikro-Rechenzentrum kombiniert die Vorteile eines Großrechenzentrums mit dem Edge Computing. Quelle: Vertiv

Fazit: Individuelle Wege gehen

Für die richtige Entscheidung, wie viel Infrastruktur zentralisiert und wie viel in Form von Edge-Computing vorgehalten werden sollte, gibt es keine Universallösung. Edge Computing kann alles umfassen: von der Installation von ganzen Mini-Rechenzentren an wichtigen Standorten bis hin zur Implementierung von Analysefunktionen über ausgewählte eingebettete Geräte oder Speichersysteme. Der gemeinsame Nenner dabei ist die Notwendigkeit einer Fernverwaltung, damit die IT-Teams die Infrastruktur auch weiterhin überwachen, analysieren und warten können, egal wo diese sich befindet. Edge Computing ist auch nicht immer eine physische, lokale Lösung. Stattdessen kann der Ansatz eine Colocation- und Cloud-Strategie beinhalten, mit der Rechenleistung näher zu entfernten Unternehmensstandorten verlagert wird, aber nicht direkt dorthin.

Die Umsetzung einer effektiven Edge-Computing-Strategie wird nicht über Nacht vonstattengehen. Sie birgt nicht nur verschiedene technische Herausforderungen, sondern ist darüber hinaus von der Mitwirkung vieler Stakeholder und ihrer Teams abhängig. Letztlich werden die IT-Verantwortlichen erfolgreich sein, die ein tiefgreifendes Verständnis der Geschäftsanforderungen mitbringen und ihre IT-Infrastruktur dahingehend flexibel anpassen.

Weitere info: