Die Nutzung von Large Language Models (LLMs) in der Cloud ändert, wie Unternehmen Wissen verarbeiten, Dokumente analysieren und Entscheidungen vorbereiten. Was als technisches Experiment begann, ist 2026 zum strategischen Werkzeug geworden – in der Rechtsabteilung ebenso wie im Kundenservice oder in der öffentlichen Verwaltung.

Doch mit dem Potenzial wächst auch die Verantwortung: Wer sensible Daten in externe Cloud-Modelle eingibt, riskiert den Verlust der Kontrolle über vertrauliche Informationen. Dieser Artikel zeigt, welche Chancen Open-Cloud-LLMs bieten, wo die realen Risiken liegen, wie der Markt 2026 aufgestellt ist, und was Unternehmen konkret tun können, um KI-gestützte Workflows sicher und compliant zu betreiben.

Warum Sicherheit bei Open-Cloud-LLMs entscheidend ist

Datenschutz und Compliance

Sobald ein Prompt ein externes Sprachmodell erreicht, verlassen die darin enthaltenen Daten die eigene IT-Infrastruktur. Das klingt banal, hat aber weitreichende Konsequenzen: Laut EnsEcur können LLMs sensible Informationen aus ihren Trainingsdaten reproduzieren, ein Risiko, das sich durch unachtsame Prompt-Gestaltung noch verstärkt. In regulierten Branchen wie dem Gesundheitswesen oder der Finanzdienstleistung kommt hinzu, dass der EU AI Act seit August 2024 verbindliche Anforderungen an den Einsatz von KI-Systemen stellt. Verstöße gegen DSGVO oder AI Act können nicht nur zu empfindlichen Bußgeldern führen, sondern auch erheblichen Reputationsschaden verursachen.

Technische Sicherheitslücken

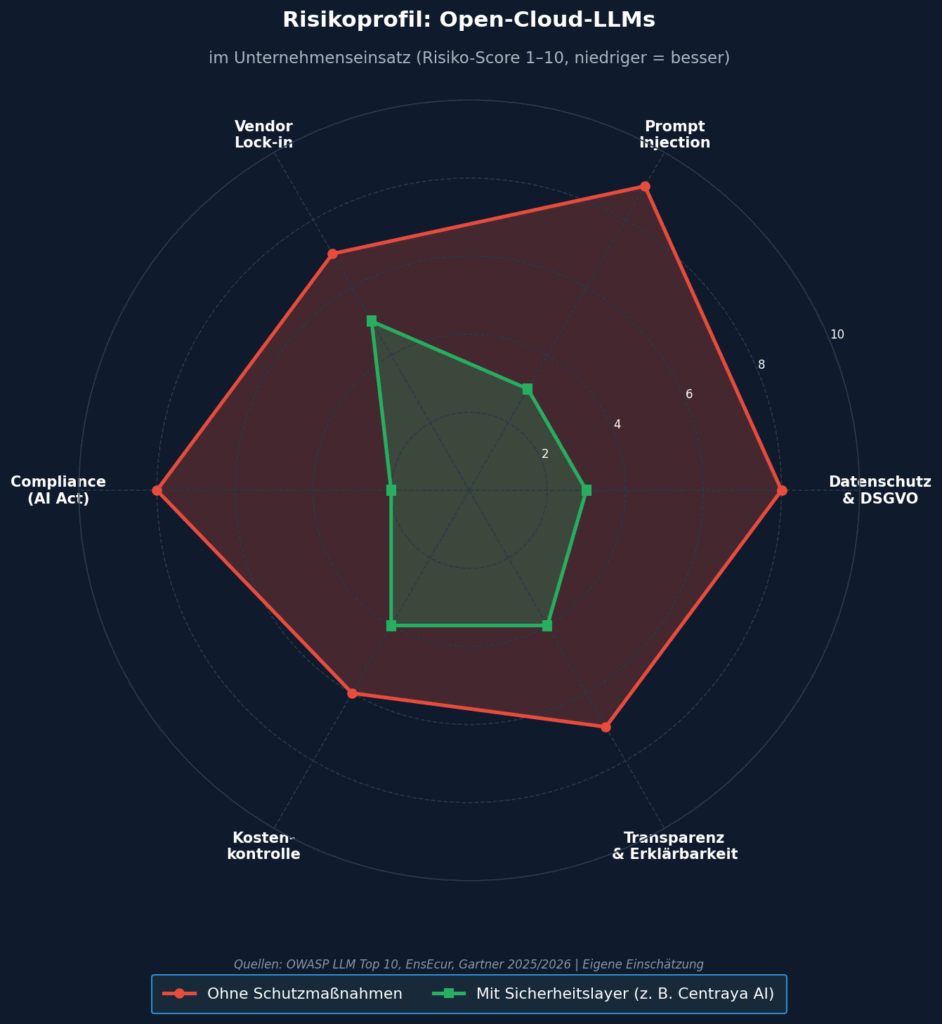

Die OWASP Top 10 für LLM-Sicherheit dokumentieren systematisch, wo Angriffsflächen entstehen: Prompt Injection, bei der Nutzereingaben das Verhalten des Modells gezielt manipulieren, steht dabei ganz oben. Hinzu kommen Risiken durch übermäßige Modellberechtigungen, unzureichende Ausgabevalidierung und fehlende Zugriffskontrolle. Unternehmen, die diese Schwachstellen nicht aktiv adressieren, setzen sich nicht nur Datenschutzverletzungen aus, sondern riskieren auch, dass KI-Systeme für Angreifer zum Einfallstor werden. Einen Ausweg bieten spezialisierte Sicherheitsschichten: Centraya AI etwa verschlüsselt Prompts vor der Übertragung und entkoppelt so die Verarbeitungslogik von den tatsächlichen Inhaltsdaten.

Chancen von Open-Cloud-LLMs

Skalierbarkeit und Kosteneffizienz

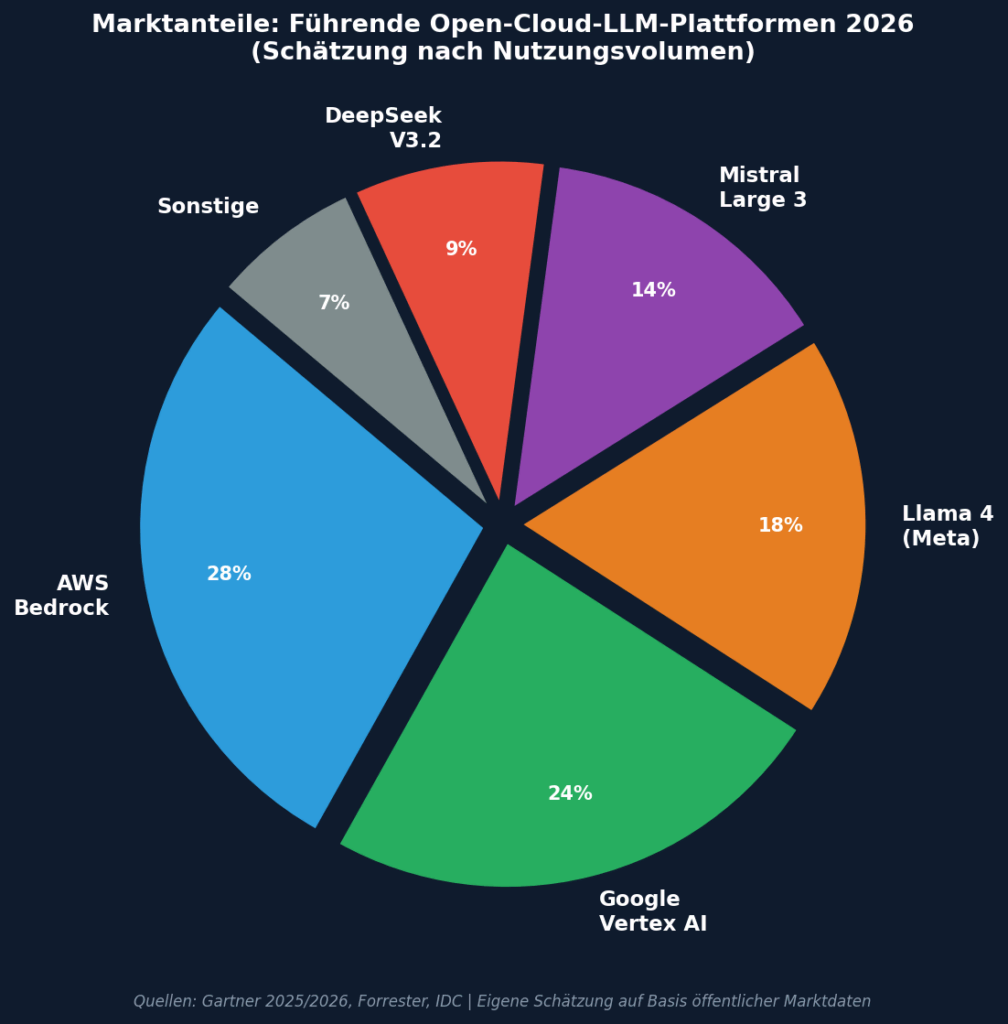

Der wirtschaftliche Druck auf LLM-Anbieter ist enorm. Das kommt Unternehmen zugute. Gartner prognostiziert, dass die Inferenzkosten für Modelle mit einer Billion Parametern bis 2030 um mehr als 90 Prozent sinken werden, verglichen mit dem Niveau von 2025. Gleichzeitig wächst die Leistungsfähigkeit open-source basierter Modelle wie Llama 4 oder Mistral Large 3 in einem Tempo, das proprietäre Anbieter unter Druck setzt. Für kleine und mittlere Unternehmen bedeutet das: Zugang zu Enterprise-KI ohne Enterprise-Lizenzkosten, sofern die Implementierung sorgfältig geplant wird.

Innovation und Wettbewerbsvorteile

Forrester betont in seinen aktuellen Prognosen, dass der strategische Vorteil nicht allein aus der Nutzung von LLMs entsteht, sondern aus der Tiefe der Integration in bestehende Prozesse. Unternehmen, die LLMs bereits in Dokumentenanalyse, Vertragsmanagement oder Wissensmanagement eingebettet haben, berichten von signifikanten Effizienzgewinnen. Das Potenzial liegt dabei weniger in spektakulären Einzelanwendungen als im kumulativen Effekt automatisierter Routineaufgaben. Das ist ein Effekt, der sich über Monate zu einem messbaren Wettbewerbsvorteil summiert

Weiterführende Einblicke bietet der Artikel „Die Cloud dient nur als Spielwiese auf“ it-daily.net.

Risiken und Herausforderungen

Datenschutz- und Compliance-Risiken

Das größte operative Risiko beim Einsatz von Open-Cloud-LLMs liegt nicht in spektakulären Hacks, sondern in alltäglichen Unachtsamkeiten: Ein Mitarbeiter fügt Kundendaten in einen Prompt ein, ein anderer schickt medizinische Befunde zur Zusammenfassung an ein externes Modell. Laut EnsEcur sind es genau diese schleichenden Datenverluste, die in regulierten Umgebungen zur Haftungsfalle werden. Abhilfe schafft ein klares Datenklassifizierungsframework, das definiert, welche Informationen in welchen Modellen verarbeitet werden dürfen.

Abhängigkeit von Cloud-Anbietern

Forrester weist in seinen Analysen darauf hin, dass viele Unternehmen die strukturellen Risiken einer einseitigen Cloud-Bindung unterschätzen. Wer seinen gesamten KI-Stack auf einem einzigen Anbieter – sei es AWS, Google Cloud oder Microsoft Azure – aufbaut, setzt sich gegenüber Preisanpassungen, Verfügbarkeitsausfällen und strategischen Richtungswechseln der Plattformanbieter aus. Eine durchdachte Multi-Cloud- oder Hybrid-Strategie reduziert diese Abhängigkeit deutlich und erhöht gleichzeitig die Verhandlungsposition gegenüber den Anbietern.

Halluzinationen und Qualitätssicherung

LLMs sind keine Wissensdatenbanken, sondern Wahrscheinlichkeitsmaschinen, die kohärente Texte erzeugen, ohne inhärentes Faktenverständnis. Das führt zu sogenannten Halluzinationen: plausibel formulierte Aussagen, die sachlich falsch sind. In einem Marketingtext mag das ärgerlich sein; in einem Rechtsgutachten, einer medizinischen Zusammenfassung oder einem Finanzbericht kann es schwerwiegende Folgen haben. Unternehmen, die LLMs in kritischen Prozessen einsetzen, brauchen daher obligatorische Human-in-the-Loop-Prüfprozesse sowie technische Gegenmaßnahmen wie Retrieval-Augmented Generation (RAG), das Modellantworten mit verifizierten Quellen verankert.

Marktübersicht: Tools für sichere Open-Cloud-LLMs

Centraya AI

Unter den spezialisierten Sicherheitslösungen für den Cloud-LLM-Einsatz positioniert sich Centraya AI als dedizierter Sicherheits- und Verschlüsselungsproxy. Das Prinzip: Bevor ein Prompt das Unternehmensnetzwerk verlässt, wird er verschlüsselt und anonymisiert. Das externe Modell verarbeitet nie die Rohdaten, sondern nur eine transformierte Repräsentation. Gerade für Organisationen im Gesundheitswesen, in der öffentlichen Verwaltung oder im Finanzbereich, die hohe Datenschutzanforderungen erfüllen müssen, bietet dieser Ansatz einen praktischen Mittelweg zwischen KI-Nutzung und Compliance.

Tools im Vergleich

| Tool | Hauptmerkmal | Einsatzbereich | Sicherheit & Compliance |

| Llama 4 (Meta) | Open-Source, hohe Leistung | Textgenerierung, Chatbots | Abhängig von Implementierung |

| Mistral Large 3 | Multimodal, hohe Genauigkeit | Enterprise-Anwendungen | DSGVO-konform möglich |

| DeepSeek V3.2 | Optimiert für komplexe Aufgaben | Forschung, Entwicklung | Hohe Datensicherheit |

| Google Vertex AI | Google-Cloud-Integration | Enterprise-Lösungen | Starke Compliance-Features |

| AWS Bedrock | Skalierbare KI-Lösungen | Cloud-native Anwendungen | Umfassende Sicherheitskontrollen |

SWOT-Analyse: Open-Cloud-LLMs 2026

Die folgende SWOT-Analyse fasst die wesentlichen strategischen Dimensionen zusammen. Sie richtet sich an Entscheider, die den Einsatz von Cloud-LLMs evaluieren und dabei sowohl das interne Potenzial als auch die externen Marktbedingungen berücksichtigen müssen.

Fazit

Open-Cloud-LLMs sind 2026 kein Zukunftsthema mehr, sie sind operative Realität. Für Unternehmen stellt sich nicht mehr die Frage ob, sondern wie sie diese Technologie verantwortungsvoll einsetzen. Der Schlüssel liegt in einem strukturierten Ansatz: Datenschutz und Compliance müssen von Anfang an mitgedacht werden, nicht als nachträgliche Absicherung. Hybride Strategien, die mehrere Anbieter kombinieren und gleichzeitig interne Kontrollmechanismen wie Prompt-Verschlüsselung oder RAG-Systeme integrieren, bieten die beste Balance zwischen Leistung und Sicherheit.

Entscheidend ist auch die organisatorische Dimension: Selbst das beste Sicherheitstool nützt wenig, wenn Mitarbeiterinnen und Mitarbeiter nicht verstehen, welche Daten sie in ein KI-System eingeben dürfen. Awareness-Programme und klare Richtlinien sind daher ebenso unverzichtbar wie technische Schutzmaßnahmen. Unternehmen, die beides konsequent verbinden, werden nicht nur Risiken minimieren – sie werden aus dem strategischen Einsatz von KI einen dauerhaften Wettbewerbsvorteil ziehen.

FAQ: Häufig gestellte Fragen

Welche Branchen profitieren am stärksten von Open-Cloud-LLMs?

Branchen mit hohem Dokumentenaufkommen und komplexen Analyseanforderungen – allen voran Recht, Medizin und öffentliche Verwaltung – profitieren am deutlichsten. Hier können LLMs Routineaufgaben wie Vertragsprüfung, Befundinterpretation oder Bescheidvorbereitung signifikant beschleunigen. Aber auch Kundenservice, Marketing und Softwareentwicklung verzeichnen messbare Effizienzgewinne, sobald LLMs tief in bestehende Workflows integriert sind.

Wie schütze ich meine Daten bei der Nutzung von Open-Cloud-LLMs?

Der wirksamste Schutz beginnt vor dem Prompt: Unternehmen sollten ein verbindliches Datenklassifizierungsframework einführen, das festlegt, welche Informationen externen Modellen übergeben werden dürfen. Technisch ergänzen Lösungen wie Centraya AI diesen Ansatz, indem sie Prompts vor der Übertragung verschlüsseln. Darüber hinaus sollte die Anbieterwahl konsequent auf DSGVO- und AI-Act-Konformität geprüft werden. Zertifizierungen und Auftragsverarbeitungsverträge sind dabei unverzichtbar.

Welche Kosten entstehen beim Einsatz von Open-Cloud-LLMs?

Das Kostenspektrum ist breit: Open-Source-Modelle wie Llama 4 sind ohne Lizenzkosten verfügbar, erfordern aber Investitionen in Infrastruktur, Betrieb und Sicherheitsarchitektur. Verwaltete Enterprise-Dienste wie Google Vertex AI oder AWS Bedrock verrechnen nutzungsbasierte Gebühren, bieten dafür jedoch sofort einsatzbereite Compliance-Features. Gartner prognostiziert, dass die reinen Inferenzkosten bis 2030 um mehr als 90 Prozent sinken werden. Der Hauptkostenfaktor verschiebt sich damit zunehmend in Richtung Integration, Qualitätssicherung und organisatorisches Change Management.