Retrieval-Augmented Generation (RAG) gilt als der pragmatischste Weg, große Sprachmodelle sicher, aktuell und nachvollziehbar mit Unternehmensdaten zu verbinden.

Dieser Praxisleitfaden erklärt, wie eine RAG-Pipeline aufgebaut wird, warum Analysten von Gartner und Forrester die Technologie als strategische Priorität einstufen und welche Komponenten wirklich zählen.

Was ist eine RAG-Pipeline – und warum brauchen Unternehmen sie?

Große Sprachmodelle wie GPT-4o oder die aktuellen Claude-Modelle von Anthropic sind beeindruckend, aber sie kennen nur, was ihnen beim Training gezeigt wurde. Dokumente, die gestern erschienen sind, interne Prozesshandbücher oder aktuelle Produktdaten: All das bleibt dem Modell verborgen. Genau hier setzt Retrieval-Augmented Generation (RAG) an.

Eine RAG-Pipeline ist eine technische Prozesskette, die ein Large Language Model (LLM) in Echtzeit mit externen, verifizierten Datenquellen verbindet. Bevor das Modell eine Antwort generiert, ruft es relevante Informationen aus einer strukturierten Wissensbasis ab und nutzt diese als Kontext. Das Ergebnis: präzisere, aktuelle und nachvollziehbare Antworten, ohne das Modell erneut trainieren zu müssen.

Das Konzept wurde ursprünglich von Meta AI (Lewis et al., 2020) vorgestellt und hat sich seitdem zum De-facto-Standard für unternehmensnahe KI-Applikationen entwickelt. Laut einer aktuellen Analyse von Mordor Intelligence wählen Unternehmen RAG heute für 30 bis 60 Prozent ihrer KI-Anwendungsfälle.Immer dann, wenn hohe Genauigkeit, Transparenz und der Einsatz eigener Daten gefragt sind.

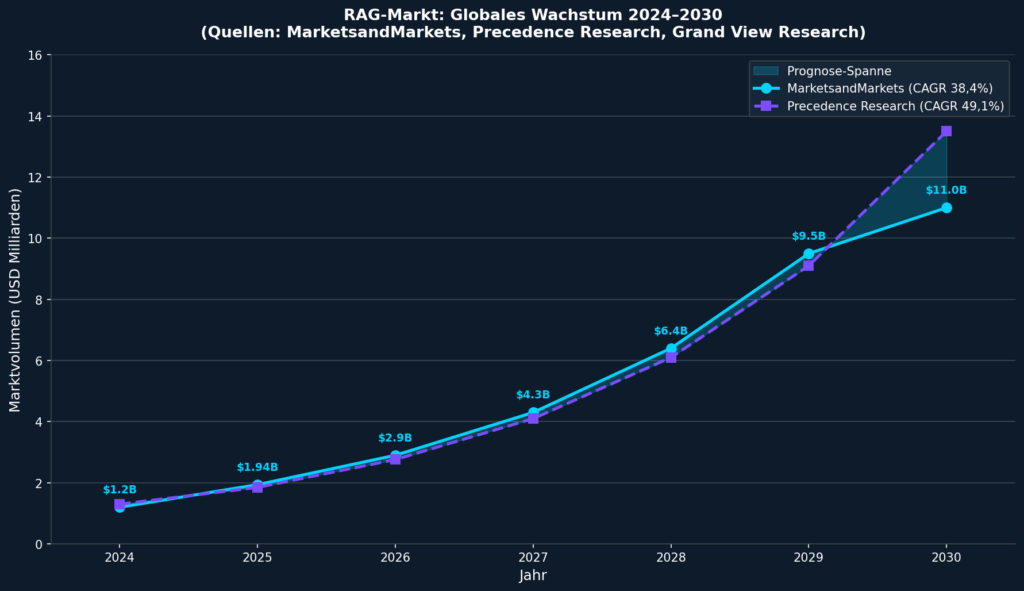

Der RAG-Markt: Explosives Wachstum bestätigt von Analysten

Die Marktentwicklung unterstreicht die strategische Bedeutung von RAG. Mehrere unabhängige Research-Häuser prognostizieren außerordentlich starkes Wachstum:

- MarketsandMarkets (2025): Der globale RAG-Markt wird von 1,94 Mrd. USD (2025) auf 9,86 Mrd. USD (2030) wachsen, ein CAGR von 38,4 %. (Quelle: MarketsandMarkets, „Retrieval-Augmented Generation (RAG) Market – Global Forecast to 2030″)

- Grand View Research (2024): Ausgehend von 1,2 Mrd. USD (2024) soll der Markt bis 2030 auf 11,0 Mrd. USD anwachsen (CAGR ca. 44–45 %). (Quelle: Grand View Research, „Retrieval Augmented Generation Market Report 2030″)

- Precedence Research (2025): Prognose von 1,85 Mrd. USD (2025) auf 67,42 Mrd. USD bis 2034 (CAGR 49,1 %). (Quelle: Precedence Research, RAG Market Analysis 2025–2034)

- Nordamerika führt den Markt mit einem Anteil von 37–38 % (2024) an, angetrieben durch frühe Enterprise-KI-Investitionen, konzentrierte Talentpools und ein starkes Cloud-Ökosystem.

Gartner positioniert RAG als strategische Investitionspriorität: Im Generative AI Hype Cycle Report 2024 empfehlen die Analysten IT-Führungskräften ausdrücklich, „RAG-Investitionen zu priorisieren“, wenn GenAI auf Basis privater und öffentlicher Unternehmensdaten eingesetzt werden soll. (Quelle: Gartner, Generative AI Hype Cycle 2024)

Forrester analysiert in seinem Report „Getting Retrieval-Augmented Generation Right“ die zentralen Herausforderungen bei RAG-Implementierungen und betont den Bedarf an konzeptioneller Abstimmung über Teamgrenzen hinweg, um die inhärente Komplexität der RAG-Architektur zu beherrschen. (Quelle: Forrester Research, Report RES182951)

Microsoft berechnet einen ROI von 3,70 USD für jeden investierten Dollar in GenAI-Programme, die Retrieval-Pipelines einbetten. (Quelle: John Roach, „Microsoft Customers Report 3.7x ROI on Generative AI“, microsoft.com)

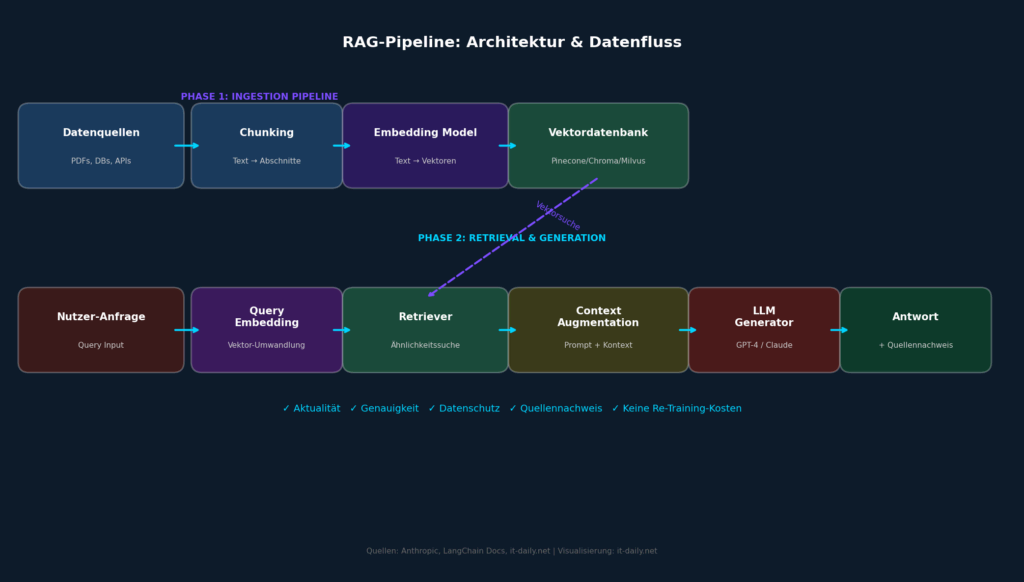

So ist eine RAG-Pipeline aufgebaut: Die zwei Hauptphasen

Der Aufbau einer RAG-Pipeline folgt einer klaren Logik, die sich in zwei Kernphasen unterteilt. Das Verständnis dieser Phasen ist die Grundvoraussetzung für eine erfolgreiche Implementierung.

Phase 1: Die Ingestion Pipeline – Daten aufbereiten

Bevor das System Fragen beantworten kann, müssen die Daten vorbereitet werden. Diese Vorbereitungsphase, auch Indexierungsphase genannt, läuft einmalig oder in regelmäßigen Zyklen ab:

- Datenquellen laden: Interne Dokumente (PDFs, Word-Dateien, Wiki-Seiten), Datenbanken, REST-APIs oder Web-Inhalte werden gesammelt. Die Qualität und Aktualität dieser Daten entscheidet maßgeblich über die Antwortqualität.

- Chunking (Zerlegung): Lange Texte werden in semantisch sinnvolle Abschnitte („Chunks“) aufgeteilt. Die optimale Chunk-Größe variiert je nach Anwendungsfall. Typisch sind 256 bis 1.024 Token.

- Embedding: Jeder Chunk wird durch ein Embedding-Modell (z. B. OpenAI text-embedding-3-large, Cohere Embed v3 oder das Open-Source-Modell BGE) in einen numerischen Vektor umgewandelt, der die semantische Bedeutung des Textes repräsentiert.

- Indexierung: Die Vektoren werden zusammen mit dem Originaltext und Metadaten (z. B. Dokumentenquelle, Datum, Abteilung) in einer Vektordatenbank gespeichert.

Phase 2: Retrieval & Generation – Abrufen und Antworten

Sobald ein Nutzer eine Anfrage stellt, durchläuft das System die zweite Phase:

- Query Encoding: Die Nutzerfrage wird durch dasselbe Embedding-Modell in einen Vektor umgewandelt.

- Retrieval (Vektorsuche): Der Retriever sucht in der Vektordatenbank nach den k ähnlichsten Chunks, basierend auf der Kosinus-Ähnlichkeit oder anderen Distanzmetriken. Moderne Implementierungen kombinieren Vektorsuche mit traditioneller Keyword-Suche (Hybrid Search) für bessere Präzision.

- Context Augmentation: Die gefundenen Textabschnitte werden zusammen mit der ursprünglichen Nutzerfrage zu einem erweiterten Prompt kombiniert.

- Generation: Das LLM erhält den angereicherten Prompt und generiert eine kontextbasierte Antwort, mit der Möglichkeit, die genauen Quelldokumente zu zitieren.

Die 6 Kernkomponenten einer RAG-Pipeline im Überblick

Eine produktionsreife RAG-Pipeline besteht aus klar definierten Bausteinen. Die folgende Tabelle gibt einen praxisnahen Überblick über die wichtigsten Komponenten, ihre Funktion und relevante Tools:

| Komponente | Funktion | Beispiele / Tools | Relevanz für Unternehmen |

| Datenquellen | Bereitstellung der Wissensbasis | PDFs, Datenbanken, REST-APIs, SharePoint | Hoch – bestimmt Qualität der Antworten |

| Embedding Model | Umwandlung von Text in Vektoren | OpenAI text-embedding-3, Cohere Embed, BGE | Kritisch – Grundlage für semantische Suche |

| Vektordatenbank | Speicherung & Ähnlichkeitssuche | Pinecone, Chroma, Milvus, Weaviate, pgvector | Hoch – Geschwindigkeit & Skalierbarkeit |

| Retriever | Auffinden relevanter Textabschnitte | Dense Retrieval, BM25, Hybrid Search | Sehr hoch – Precision der Ergebnisse |

| LLM (Generator) | Generierung der finalen Antwort | GPT-4o, Claude (Anthropic, aktuelle Gen.), Llama 3.3, Mistral | Hoch – Qualität der Ausgabe |

| Orchestrierungs-Framework | Steuerung des gesamten Prozesses | LangChain, LlamaIndex, Haystack | Mittel-Hoch – Entwicklungsgeschwindigkeit |

Tab. 1: Kernkomponenten einer RAG-Pipeline mit Funktionsbeschreibung und Toolempfehlungen. (Quelle: it-daily.net-Redaktion, basierend auf LangChain-, LlamaIndex- und Pinecone-Dokumentation, Stand März 2026)

Die Vorteile von RAG gegenüber Fine-Tuning und Prompt Engineering

Unternehmen, die LLMs produktiv einsetzen wollen, stehen vor der Wahl: Sollen sie das Modell feinabstimmen (Fine-Tuning), mit cleveren Prompts arbeiten (Prompt Engineering) oder RAG einsetzen? Für die meisten Unternehmensanwendungen hat RAG klare Vorteile:

1. Aktualität ohne Retraining

Fine-Tuning ist kostspielig und zeitaufwendig. Ein einmaliger Trainingslauf für GPT-4-Klasse-Modelle kann Zehntausende Euro kosten und Wochen dauern. RAG hingegen erlaubt es, neue Dokumente innerhalb von Minuten in die Wissensbasis einzuspeisen. Der „Knowledge Cutoff“ des Basismodells spielt damit keine Rolle mehr.

2. Drastische Reduzierung von Halluzinationen

Einer der kritischsten Schwachpunkte von LLMs ist das Halluzinieren, also das Generieren sachlich falscher Informationen mit hoher Scheingewissheit. Feldstudien zeigen, dass RAG-Pipelines Halluzinationen um 70 bis 90 Prozent reduzieren können, da die Antwort stets auf abgerufenen, verifizierten Quellen basiert. (Quelle: Mordor Intelligence, „Retrieval Augmented Generation Market Report“, 2024; Makebot AI Research Team, „Enterprise RAG Benchmarks 2025″)

3. Datenschutz und Datensouveränität

Unternehmenseigene Daten verlassen bei RAG nicht das kontrollierte IT-Umfeld. Die Wissensbasis wird intern gehalten, das LLM erhält nur den jeweils relevanten Kontext – keine Trainingsdaten, kein Modell-Update beim Anbieter. Gerade für DSGVO-konforme Implementierungen in der EU ist dies entscheidend.

4. Nachvollziehbarkeit und Quellennachweis

Eine gut konzipierte RAG-Pipeline kann zu jeder Antwort die exakten Quelldokumente ausgeben. Das schafft Vertrauen, ist für Compliance-Anforderungen unverzichtbar und erleichtert das Debugging bei fehlerhaften Antworten.

5. Kosteneffizienz

Im Vergleich zu Fine-Tuning und dem Einsatz proprietärer Modelle mit großen Kontextfenstern ist RAG oft kostengünstiger, besonders bei häufig wechselnden Daten. LLMs sind derweil laut Marktbeobachtern inzwischen rund sieben Mal schneller und günstiger als noch 2023. (Quelle: Vectara, „Top Enterprise RAG Predictions 2025″)

RAG-Pipeline erzeugen: Der Implementierungspfad für Unternehmen

Der Weg von der Idee zur produktionsreifen RAG-Pipeline folgt typischerweise diesem bewährten Vorgehen:

Schritt 1: Pilotanwendungsfall auswählen

Gartner empfiehlt, mit einem klar messbaren Anwendungsfall zu starten, etwa einem internen HR-FAQ-Bot oder einem Assistenten für technische Dokumentation. Der Geschäftswert muss von Anfang an quantifizierbar sein. (Quelle: Gartner, „How to Supplement Large Language Models with Internal Data“, 2024)

Schritt 2: Datenbasis klassifizieren und kuratieren

Dokumente werden nach Typ (strukturiert, semi-strukturiert, unstrukturiert), Aktualität und Sensitivitätsstufe kategorisiert. Redundante, veraltete oder fehlerhafte Inhalte sollten vor dem Indexieren bereinigt werden. Garbage In, Garbage Out gilt im RAG-Kontext besonders streng.

Schritt 3: Technologie-Stack wählen

Die populärste Kombination für Einsteiger: LangChain oder LlamaIndex als Orchestrierungsframework, OpenAI Embeddings oder ein Open-Source-Modell (z. B. BGE, E5) für Vektoren, Chroma oder pgvector als einsteigertaugliche Vektordatenbank. Für produktionsreife Deployments bieten sich Pinecone, Milvus oder Weaviate an.

Schritt 4: Chunking-Strategie optimieren

Die Chunk-Größe und -Strategie hat enormen Einfluss auf die Retrieval-Qualität. Rekursives Chunking, Semantic Chunking oder Parent-Child-Chunking sind bewährte Ansätze. Metadaten-Anreicherung jedes Chunks (Quelle, Datum, Abteilung) verbessert die Nachvollziehbarkeit und ermöglicht spätere Filterung.

Schritt 5: Evaluierung und Monitoring einrichten

Ohne Metriken kein Fortschritt. Relevante KPIs für RAG-Pipelines sind Faithfulness (Antworttreue gegenüber der Quelle), Answer Relevance (Relevanz der Antwort für die Frage) und Context Recall (Vollständigkeit der abgerufenen Kontexte). Frameworks wie RAGAs oder LangChain Evaluation ermöglichen automatisierte Tests.

Schritt 6: Agentic RAG als nächste Evolutionsstufe

Die Weiterentwicklung von RAG hin zu Agentic RAG, also KI-Agenten, die eigenständig entscheiden, welche Retrieval-Schritte für eine komplexe Aufgabe notwendig sind, ist der aktuelle Frontier. Laut Vectara werden komplexe Agentic-RAG-Workflows jedoch erst 2026/2027 breit im Enterprise-Einsatz ankommen. (Quelle: Vectara, „Top Enterprise RAG Predictions for 2025″)

Typische Anwendungsfälle im Unternehmenskontext

- Customer Service & Support: Chatbots, die auf aktuellen Produkthandbüchern, FAQs und Tickethistorien basieren, lösen Anfragen präzise und verweisen auf konkrete Abschnitte.

- Legal & Compliance: RAG-gestützte Assistenten durchsuchen Vertragsarchive, Regulatorik-Dokumente und interne Richtlinien. JPMorgan Chase etwa setzt RAG-Agenten für Compliance-Queries ein und erzielte Produktivitätssteigerungen von 200 bis 2.000 Prozent. (Quelle: Kanerika Inc., „Agentic AI 2025″)

- HR & Wissensmanagement: Mitarbeiter befragen einen internen Assistenten zu Urlaubsrichtlinien, Onboarding-Prozessen oder IT-Sicherheitsregeln, und erhalten sofort eine quellenbasierte Antwort.

- Technische Dokumentation & IT-Betrieb: RAG-Pipelines durchsuchen Runbooks, Incident-Protokolle und API-Dokumentationen für IT-Teams in Echtzeit.

- Healthcare: Klinische Entscheidungsunterstützungssysteme, die aktuelle Leitlinien und Peer-Reviewed-Studien in die Antwortgenerierung einbetten. Der Healthcare-Sektor hält laut Precedence Research (2025) mit 36,61 % den größten Marktanteil im RAG-Bereich.

Herausforderungen und Fallstricke bei der RAG-Implementierung

Trotz der klaren Vorteile identifiziert Forrester mehrere strukturelle Herausforderungen, die RAG-Projekte zum Scheitern bringen können:

- Datenqualität: Veraltete, inkonsistente oder schlecht strukturierte Quelldaten führen direkt zu schlechten Antworten.

- Chunking-Fehler: Zu große oder semantisch inkohärente Chunks verschlechtern das Retrieval erheblich.

- Vendor Fragmentation: Ein typisches DIY-RAG-Projekt involviert mehr als 20 APIs und 5 bis 10 Anbieter. Das erhöht Komplexität und Wartungsaufwand signifikant. (Quelle: Vectara, 2025)

- Sicherheit: Prompt-Injection-Angriffe, bei denen Schadcode über Nutzereingaben in den RAG-Kontext eingeschleust wird, sind eine reale Bedrohung. OWASP LLM Top 10 und UK NCSC/CISA-Leitlinien bieten hier Orientierung.

- Compliance: Mit dem EU AI Act (in Kraft seit August 2024, gestufte Pflichten bis 2026/2027) müssen Unternehmen ihre RAG-Systeme dokumentieren und Risikokategorien zuordnen.

Tools, Frameworks und weiterführende Ressourcen

Die RAG-Toollandschaft hat sich rasant entwickelt. Folgende Ressourcen sind für den Einstieg und die Vertiefung empfehlenswert:

- Orchestrierungsframework: LangChain Documentation

- Daten-Framework für LLM-Applikationen: LlamaIndex (ehemals GPT Index)

- Managed Vektordatenbank: Pinecone

- Evaluierungsframework: RAGAs – RAG Evaluation Framework

- Forrester Report: Getting RAG Right

- Gartner Innovation Insight (Zusammenfassung): RAG as a Service

- Praxisleitfaden Agentic RAG Pipeline (Level Up Engineering)

- Weitere Artikel zu Enterprise KI: it-daily.net

Häufig gestellte Fragen (Q&A) zur RAG-Pipeline

Was ist der Unterschied zwischen RAG und Fine-Tuning?

Fine-Tuning verändert die Gewichte des Sprachmodells durch weiteres Training auf domänenspezifischen Daten. RAG lässt das Modell unverändert und reichert jeden Inference-Schritt mit externem Kontext an. RAG ist günstiger, flexibler und besser geeignet, wenn Daten sich häufig ändern.

Welche Vektordatenbank ist die beste für den Einstieg?

Für Prototypen und kleinere Projekte eignet sich Chroma (Open Source, lokal deploybar) hervorragend. Für produktionsreife, skalierbare Deployments sind Pinecone (Managed Service) und Milvus (Open Source, hochskalierbar) die führenden Optionen. pgvector ist interessant für Teams, die bereits PostgreSQL einsetzen.

Wie groß sollten die Chunks einer RAG-Pipeline sein?

Es gibt keine universelle Antwort. Typisch sind 256 bis 1.024 Token pro Chunk. Kleinere Chunks erhöhen die Präzision beim Retrieval, liefern aber weniger Kontext. Größere Chunks enthalten mehr Zusammenhang, können aber das Retrieval unschärfer machen. A/B-Tests mit dem eigenen Datensatz sind unerlässlich.

Kann RAG in der Private Cloud oder On-Premises betrieben werden?

Ja. Viele Unternehmen mit strengen Datenschutzanforderungen (Banken, Behörden, Gesundheitswesen) betreiben RAG-Pipelines vollständig On-Premises mit Open-Source-Modellen (z. B. Llama 3.3, Mistral) und lokalen Vektordatenbanken. Laut Precedence Research (2025) wächst das On-Premises-Segment besonders schnell.

Wie zuverlässig sind RAG-Antworten?

Deutlich zuverlässiger als reine LLM-Antworten: Feldstudien berichten von einer Halluzinationsreduktion von 70 bis 90 Prozent. Die Verlässlichkeit hängt stark von der Qualität der Datenquellen, der Chunking-Strategie und dem Retrieval-Algorithmus ab.

Was ist Agentic RAG?

Agentic RAG erweitert klassische RAG-Pipelines um autonome KI-Agenten, die mehrstufige Retrieval-Strategien selbst planen, Tools aufrufen und Antworten iterativ verfeinern. Dies ermöglicht die Bearbeitung komplexer, mehrteiliger Anfragen. Gartner prognostiziert, dass bis 2025 bereits 40 Prozent der Enterprise-Workflows agentic AI-Komponenten enthalten werden.