Flexibilität, Skalierbarkeit nach Bedarf und Back-End-Services durch den Provider: die wichtigsten Vorteile der Cloud sind hinreichend bekannt und werden von vielen Unternehmen geschätzt. Das Serverless-Infrastructure-Konzept geht noch einen Schritt weiter und will erreichen, dass sich Unternehmen und deren Entwickler gar nicht mehr um die Server und deren Konfiguration kümmern müssen.

Gleich vorweg: Ohne physikalische Hosts oder virtuelle Ressourcen wird es nicht gehen. Diese IT-Infrastruktur soll jedoch aus Sicht der Unternehmen weiter in den Hintergrund und noch mehr in die Verantwortung der Cloud-Provider rücken. Die Vision: Unternehmen werden dadurch noch flexibler, plattformunabhängiger und senken den administrativen Aufwand. Wie funktioniert das praktisch?

Automatisch die passende Laufzeit-Umgebung

Zwar muss ein Unternehmen, das Cloud-Services nutzt, heute schon keine eigene IT-Infrastruktur mehr anschaffen. Aber jedes IaaS-, SaaS- und PaaS-Szenario muss zunächst mehr oder weniger individuell konfiguriert werden. Zudem benötigt jede Anwendung entsprechende Spezifikationen für die Cloud-Schnittstelle. So werden viele Applikationen bereits heute cloud-native entwickelt, das heißt, sie werden gezielt so konzipiert, dass sie die Vorteile der Cloud-Services optimal nutzen können.

Mit den monolithischen Programmen mit ihren aufwändig halbjährlich ausgerollten Releases – so wie noch vor zehn Jahren üblich – hat das nichts mehr zu tun. Software-Applikationen sind heute Microservices: flexible Einzelstücke eines größeren Ganzen, unkompliziert lauffähig, schnell anpassbar und wenn nötig ohne größere Nebenwirkungen zu entsorgen.

Für das Serverless-Konzept kommen nun diese beiden Entwicklungen – Cloud Computing und Microservices – zusammen. Für die Ausführung in der Cloud-Umgebung wird den Microservices eine Funktion mitgegeben. In dieser ist ein Event, der die Ausführung der Anwendung auslöst und die benötigte Laufzeit-Umgebung definiert. Dieser Umgang mit den Microservices hat sich bereits durch die sogenannten Container-Technologien bewährt, bei denen der Software ebenfalls alle notwendigen Informationen mit in den Container gepackt werden. Der Vorteil: Derjenige, der den Microservice entwickelt hat, muss sich nicht um die Bereitstellung der benötigten Infrastruktur kümmern. Er gibt lediglich die Vorgaben mit, was sein Programm benötigt.

Serverless Infrastructure – die Vorteile:

- Alle Vorteile der Cloud: Flexibilität und Kostentransparenz bei der IT-Infrastruktur

- Infrastruktur-Unabhängigkeit: Konzentration auf die Entwicklung von Anwendungen und Services

- Schnelleres Deployment von Anwendungen und Services

- Gegenüber der Cloud nochmals sinkender Administrationsaufwand

- Automatische Skalierung bei der Ausführung

- Die Ausführung von Services lässt sich deutlich beschleunigen, besonders wenn diese sehr oft ausgeführt werden sollen

Einsatzszenarien für Serverless

Event-getriebene Microservices haben vor allem dann Vorteile, wenn kleinere Requests immer und immer wieder abgearbeitet werden müssen. Das ist zum Beispiel der Fall bei der Konsolidierung großer, unstrukturierter Datenmengen aus mehreren Quellen in einem Data Warehouse, sogenannten ETL-Prozessen (Extract, Transform, Load). Ebenso ist es vorstellbar, dass Serverless Computing eine größere Rolle im Zusammenhang mit dem Internet der Dinge (IoT) spielen wird.

Auch hier geht es um zahlreiche Datenerfassungsquellen – die Sensoren – und eher kleinere Dateneinheiten, die aggregiert werden müssen. So könnte die dazugehörige Funktion beispielsweise die Anweisung enthalten, die Datenmengen so zu verteilen, dass jeweils die günstigsten oder performantesten Cloud-Angebote für die Verarbeitung genutzt werden.

Nicht jedermanns Sache – die Bedenken:

- Individuelle Anbindungen an Infrastruktur-Komponenten (z. B. Datenbank) nur schwer möglich

- Kann zu Vendor-Lock-in führen

- Schwindende Kontrolle über die IT-Infrastruktur

- Komplexes und schnell unübersichtlich werdendes Aufrufverhalten der Microservices untereinander

- Standard-Definitionen noch in der Anfangsphase

Erste Standardisierungs-Initiative: Knative

Bisher war es nicht ganz einfach, container-basierte Funktionen in Serverless-Umgebungen einzusetzen. Denn die Spezifikation, die dem Microservice über die Funktion mitgegeben werden muss, hing davon ab, welcher Cloud-Service zugrunde lag. Sprich: Funktionen für Amazon Web Services mussten andere Voraussetzungen erfüllen als Funktionen für Microsoft Azure oder die Google Cloud. Dem Grundsatz von „Serverless“ steht dies insoweit entgegen, als dass der Anwender sich ja eben nicht um die Anforderungen einer spezifischen Plattform kümmern will.

Eine Open-Source-Initiative, ins Leben gerufen von Google und Pivotal, will künftig Abhilfe schaffen: Die Plattform Knative soll als verbindende Zwischenebene fungieren und es ermöglichen, dass Funktionen flexibel innerhalb einer Cloud oder beliebig zwischen mehreren verschiedenen Clouds hin und her portierbar sind. Knative beruht auf dem Container-Orchestrierungs-Werkzeug Kubernetes. Es stellt zudem vorgefertigte Funktionen zur Verfügung, die es erleichtern, Serverless Services zu deployen und auszuführen. Dazu gehören beispielsweise die Zusammenstellung des Containers, das Traffic-Managements während des Deployments oder das automatisierte Skalieren der Workloads.

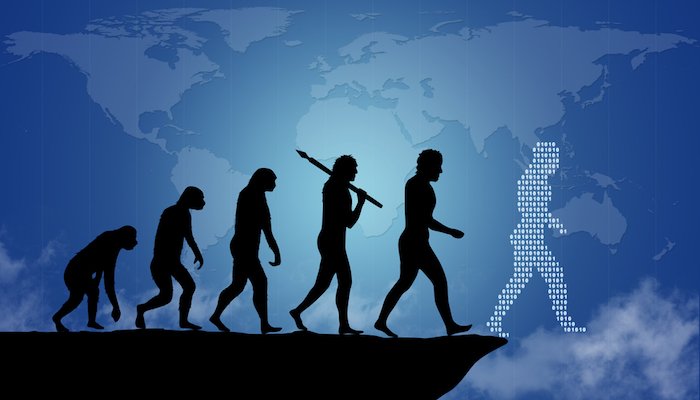

Die Initiative unterstreicht, dass Serverless künftig an Bedeutung gewinnen wird und sich auch große führende Unternehmen damit beschäftigen, die praktische Umsetzung zu vereinfachen. So könnte Serverless Computing die konsequenteste Option des Cloud Computing werden.

Mehr Informationen zu Knative: von Pivotal auf https://pivotal.io/de/knative und von Google auf https://cloud.google.com/knative/.

Jürgen Hoffmann, Senior Manager Platform Architecture, Pivotal