Eines der meistdiskutierten Themen der letzten Monate ist die Lieferkettenoptimierung. Im Zuge der Corona-Pandemie hat sich der Fokus deutlich verschoben.

Es geht primär nicht mehr um Kostensenkung, sondern um eine ganzheitliche Betrachtung globaler Warenströme, besonders unter Risikoaspekten. Egal ob Pandemie, Rohstoffknappheit oder die Blockade des Suezkanals – die Verwundbarkeit komplexer, kosteneffizienter Lieferketten haben in den letzten beiden Jahren viele Unternehmen ganz direkt zu spüren bekommen.

Die Coronakrise hat zudem gezeigt: Globale Lieferketten sind extrem anfällig für Risiken. Richtig gesteuert bieten sie allerdings weiterhin große Vorteile in Bezug auf Kosten und Sicherheit. Mit einer gezielten, IT-basierten Verknüpfung von Unternehmensdaten und Erfahrungswerten der verantwortlichen Managementfunktionen lassen sich verborgene Potenziale heben, Risiken verringern und echte Wettbewerbsvorteile schaffen. Unterstützt wird dies idealerweise durch einen neutralen Moderator, der Analyseergebnisse zusammenführt und die Ableitung von Handlungsempfehlungen ermöglicht.

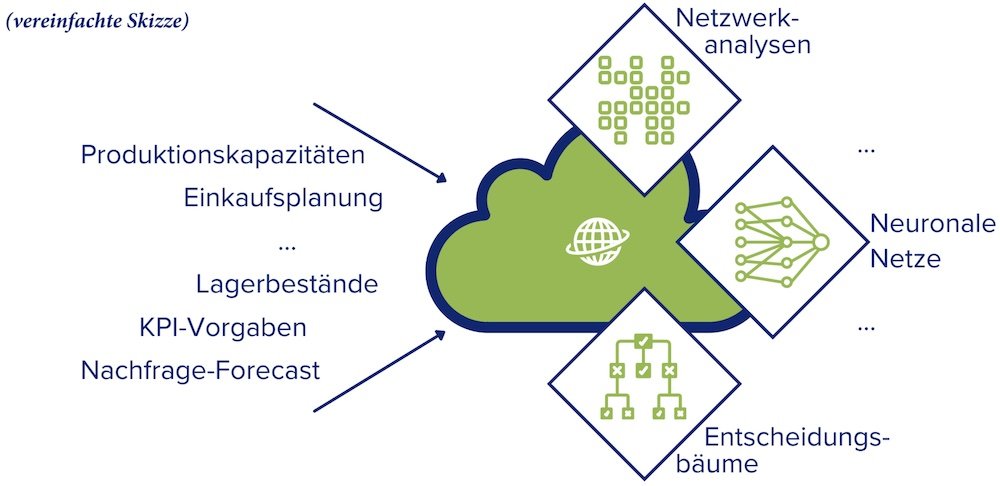

Wie können global operierende Unternehmen ihre Erfahrungen nutzen, um die eigene Position am Markt zu verbessern und dadurch Wettbewerbsvorteile zu erlangen? Indem sie mithilfe einer digitalen Plattform, auf der relevante interne und externe Daten zusammengeführt werden, zielgerichtet faktenbasierte Entscheidungen treffen.

Die Basis

Was kann hier helfen? Ein Ansatz ist, neuestes mathematisches Wissen für datenbasierte Optimierungen in Unternehmen nutzbar machen und mögliche Verbesserungen dann auch nachhaltig umsetzen – das wäre ein Mehrwert.

In der Praxis bedeutet dies eine leistungsfähige Supply Chain Daten-Plattform und Data Scientists einzusetzen. Man könnte zwar meinen, je mehr Daten zur Supply Chain sich auf einer Plattform zusammenführen lassen, desto besser. Grundsätzlich ist das richtig, allerdings müssen hierbei immer die Ziele im Auge behalten werden: Welche Fragen sollen beantwortet werden? Welche Stellschrauben optimiert? Welche Risiken bewertet, reduziert oder vermieden? Je nach Fragestellung müssen die richtigen Daten in ausreichender Qualität vorhanden und analysierbar sein.

Ein Unternehmen, dessen Lagerbestände sich in deutlich überhöhtem Working Capital niederschlagen, benötigt zunächst eine präzise Übersicht darüber, welche Lagerorte weltweit vorhanden sind. Das klingt naheliegend, ist bei globalen Produktionsnetzwerken, Consignment Stocks für Großkunden und länderspezifischen Partnernetzwerken häufig aber gar nicht so offensichtlich.

Dann ist zu überlegen, in welcher Form sich Bestellungen, Nachfrageprognosen, Produktionskapazitäten und rechtliche Verpflichtungen gegenüber Kunden in einem Datenraum zusammenführen lassen. Bei vielen Unternehmen müssen zusätzlich finanzielle KPIs berücksichtigt werden. Im Detail ergibt sich die Komplexität schließlich durch Produktvarianten, unterschiedliche Qualitätsstufen und die Wahl zwischen unterschiedlichen Rohstoffen und Lieferanten.

Je zahlreicher und komplexer die Verbindungen und daraus resultierenden Datensätze sind, desto zentraler ist eine leistungsfähige Daten-Plattform. Selbst aufwendige Analysetechniken liefern keinen Mehrwert, wenn die zugehörigen Daten nicht in kurzer Zeit – bestenfalls in Echtzeit – abgerufen werden können. Nicht zuletzt spielt die Datenintegrität und -bereinigung eine wichtige Rolle. Das altbekannte Prinzip „Garbage in, garbage out.“ gilt noch immer, und das Aussortieren beziehungsweise intelligente Korrigieren fehlerhafter und unvollständiger Datensätze ist ein nicht zu unterschätzender Erfolgsfaktor.

Blick auf eine vereinfachte Darstellung einer Supply Chain Daten-Plattform

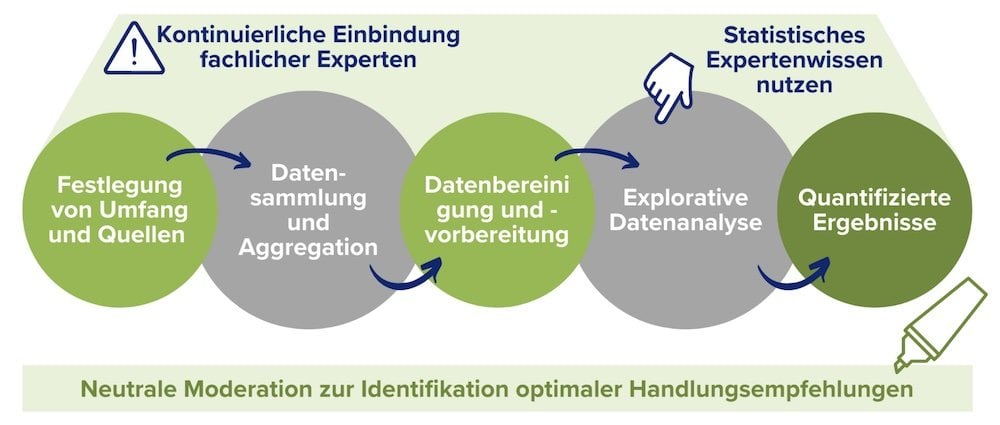

Mustererkennung und Simulationslösungen

Erfolgreiche datengetriebene Lösungen beginnen immer mit einem konkreten Entscheidungsbedarf für das Management und der Identifizierung von erklärenden Daten. Sobald eine sinnvolle Datenmenge zusammengeführt und aufgearbeitet wurde, können zunächst explorative Datenanalysen vorgenommen werden. Mit statistischer Expertise lässt sich vergleichsweise schnell und gezielt nach Mustern und Korrelationen in historischen Daten suchen. Anschließend werden diese auf ihre Vorhersagekraft überprüft und gegebenenfalls um externe Datensätze wie beispielsweise Rohstoffpreisentwicklungen, länderspezifisches Wirtschaftswachstum oder Inflationsdaten ergänzt.

Darüber hinaus sollten praxisnahe, realistische Anwendungsfälle für Simulationen aufgebaut werden, um den Entscheidungsträgern Auswirkungen ihrer Entscheidungen quantitativ darzustellen. Dabei ist es essenziell, das richtige Abstraktionslevel der Daten und geeignete Visualisierungsformen zu wählen. Im Alltag einer globalen Lieferkette kann dies Themen wie Make-or-Buy, Lagerbestände und vieles mehr umfassen. Nicht zu unterschätzen sind auch Simulationen der eingangs genannten Risikofragestellungen. Wo ist ein redundantes Produktionsnetzwerk sinnvoll? Welche Konsequenzen hätte die Aufteilung des Zentrallagers auf mehrere Standorte und wie stark verändert sich dadurch die Liefersicherheit? Wird die zunehmende Nachfrage eines Großkunden zu einem Lieferengpass führen?

Einbindung fachlicher Experten zur Entwicklung von zielgenauen Applikationen

Solche Fragen kann man nur beantworten, wenn man sich auf eine intelligente Auswertung der Daten mit zielgenauen Applikationen fokussiert. Hierfür ist es erforderlich, die identifizierten Muster und Simulationsmöglichkeiten mit den Erfahrungen, Meinungen und Ideen von Experten abzugleichen.

Sämtliche in den Prozess involvierte Funktionen von Key Account Management bis Rohstoffeinkauf sind hier einzubinden. Dadurch wird nicht nur die Relevanz, sondern auch die Akzeptanz verfügbarer Analysen sichergestellt. Welche Faktoren beeinflussen die zukünftige Nachfrage? Wieso sind Einzelpositionen wie Flugkosten für Eiltransporte wann gestiegen? Welche Gesamtkosten, inklusive drohender Umsatzverluste, stehen hinter einer möglichen Produktionsverlagerung? Jede Unternehmensfunktion hat einen eigenen Fokus und kann für die Datenanalysen sowohl Fragen als auch Teile der Antworten beisteuern.

Am Entwicklungsprozess der Applikation Beteiligte werden diese auch gerne nutzen, um von den Ergebnissen zu profitieren. So lassen sich Auswertungen und Simulationen im Business-Alltag gewinnbringend nutzen.

So sehen die wesentlichen Schritte zur Datenanalyse aus

Fazit: Datengestützte Lieferkettenoptimierung als Wettbewerbsvorteil

Wertschaffende Datenanalysen basieren auf vielen klugen Fragen und liefern in der Folge Antworten, die einen echten Wettbewerbsvorteil darstellen. In Zeiten von Knappheit ist König, wer zuverlässig liefern kann. In Zeiten von Überkapazitäten sind Kostenoptimierung und Kundenzufriedenheit in Einklang zu bringen. Für Ersteres wäre eine vollumfassende Produktion und Lagerhaltung in jedem großen Abnehmerland sinnvoll, mit Blick auf Zweiteres verspricht das langfristig den sicheren Weg in die Insolvenz.

Globale Lieferketten sind weiterhin erstrebenswert, müssen sich aber an aktuelle Gegebenheiten und sich ändernde Rahmenbedingungen anpassen können. Daten allein können eine globale Lieferkette nicht perfektionieren – typische menschliche Konflikte wie zwischen Supply Chain und Vertrieb wird es auch in datenaffinen Unternehmen immer geben. Hier braucht es häufig einen neutralen Moderator der basierend auf Zahlen, Daten und Fakten Konflikte im Interesse des Gesamtunternehmens optimal löst.

Autoren:

Michael Nesnov

www.santiago-advisors.com