Künstliche Intelligenz stellt Unternehmen vor völlig neue Herausforderungen. Gerade mit Inkrafttreten des EU AI Acts gewinnt das Thema KI-Governance an Bedeutung. Wir haben mit Christian Hammer, Team Lead AI Advisory bei der adesso SE, über die praktischen Implikationen gesprochen und erfahren, wie Unternehmen den Spagat zwischen Compliance und Innovation meistern können.

Bevor wir über Unternehmensstrategien sprechen – wie nutzen Sie persönlich KI im Alltag?

Christian Hammer: Ich persönlich nutze verschiedene Diffusionmodelle zur Bildgenerierung für unterschiedliche Gelegenheiten. Außerdem verwende ich DeepL als Übersetzungswerkzeug, da in meinem privaten Umfeld Menschen mit verschiedenen Sprachhintergründen sind. Dazu kommen zwei bis drei Sprachmodelle für private Zwecke, die alle ihre Stärken und Schwächen haben.

Sie haben als Team Lead AI einen anderen Blick darauf: Worauf sollten Verbraucher bei solchen Anwendungen besonders achten?

Christian Hammer: KI nimmt zwar den Intelligenzbegriff, aber da ist ja keine Intelligenz drin. In künstlicher Intelligenz steckt ein mathematisches Modell, das Wahrscheinlichkeiten berechnet. Und die Wahrscheinlichkeit, die das Ergebnis repräsentiert, die kann 50%, die kann aber auch weniger als 50% oder mehr als 50% betragen. Verbraucher sollten sich immer die Ergebnisse anschauen und kritisch hinterfragen: Ist das richtig, kann das sein? Besonders generative KI neigt zur Halluzination und kein Modell wird zugeben, etwas nicht zu wissen. Stattdessen liefern sie Antworten, die oft sehr plausibel klingen. Es ist eine disruptive Technologie, die man gut einsetzen und bei der man sich viel bedienen kann, aber sie arbeitet rein repetitiv und nicht kreativ. Die Kreativität kommt nicht vom Modell, sondern von uns Menschen durch den Prompt.

Wenn wir über Risiken sprechen – welche Rolle spielt der Datenschutz für Verbraucher bei KI-Anwendungen?

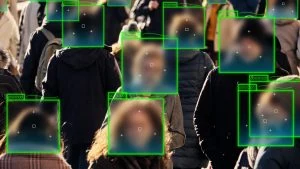

Christian Hammer: Im Internet ist nichts umsonst. Wenn ich einen kostenlosen Service habe, dann bezahle ich nicht mit Geld dafür, sondern mit meinen Daten. Es ist egal, ob ich in soziale Medien reinschaue oder Multimedia-Plattformen nutze. Das, was ich den Plattformen über mein Nutzungsverhalten mitgebe, indem ich etwas anklicke, bestimmt, was ich als nächstes zu sehen bekomme. Das ist für die Werbeindustrie extrem interessant und ich werde irgendwann gläsern.

Dieses sehr hohe Risiko ist schwierig ins Bewusstsein der Verbraucher zu bringen, weil der kostenlose Vorteil höher gewichtet wird. Niemand macht sich Gedanken darüber, was das bedeutet. Egal welche Altersgruppe, weder meine Kinder noch meine Eltern denken darüber nach. Sie benutzen es einfach. Es ist schön, es ist niederschwellige Technologie, aber die Gefahr ist trotzdem da. Am Ende ist es sehr einfach, durch KI diese ganzen Profile zu kombinieren und auszuwerten, besonders wenn ein Unternehmen eine große Plattform mit verschiedenen Apps oder Services anbietet. So kann passgenaue Werbung auf mich zugeschnitten werden, die mich viel stärker zu einem Kauf oder Verhalten verleitet, als es eine unspezifische Werbekampagne etwa an einem Flughafen könnte.

Lassen Sie uns zum Unternehmenskontext wechseln. Wie definieren Sie den Begriff KI-Governance?

Christian Hammer: KI-Governance ist ein Rahmenwerk, um künstliche Intelligenz im Unternehmenskontext in Verantwortung, Rollen und Prozesse zu gießen. Es sichert Unternehmenswerte ab, macht Entscheidungsprozesse transparent und sorgt dafür, dass Auditoren nachvollziehen können, was wozu geführt hat. Das Ganze muss im regulatorischen Einklang stehen, mit dem EU AI Act, Data Act, Digital Markets Act, Cyber Resilience Act und weiteren sektoralen Regularien.

Die Europäische KI-Verordnung (EU AI Act) ist ja seit kurzem in Kraft. Wie hat diese Regulierung Ihre Arbeit konkret beeinflusst?

Christian Hammer: Für viele Unternehmen in Europa mag die Verordnung als Gängelei erscheinen, aber sie zwingt sie, sich mit der Regulatorik zu beschäftigen. In den letzten vier, fünf Jahren haben wir viele prototypische KI-Anwendungen in der Industrie gesehen, teilweise auch gefährliche Ansätze. Da haben Firmen KI-Systeme geschaffen, indem sie sich einen Informatikstudenten geholt haben, der eben mal das Modell aufgebaut hat. Der ist jetzt aber nicht mehr da. Wer ist jetzt für das Modell verantwortlich? Der EU AI Act zwingt jetzt Unternehmen dazu, sich darüber Gedanken zu machen, was ihre Produkte eigentlich für ein Risiko beinhalten, vor allem für den Nutzenden beziehungsweise für denjenigen, dessen Daten verarbeitet werden. In dem Moment, in dem eine bestimmte Risikoklasse erreicht wird, muss man deutlich mehr tun, als zu sagen: „Ich lasse das jetzt so weiterlaufen.“

Das beflügelt uns natürlich in der KI-Strategie bei Kunden, darauf hinzuwirken, dass die Prozesse definiert und eingeführt werden und die KI-Organisation aufgebaut wird. Das Bewusstsein ist da, weil die Begriffe im EU AI Act nicht neu sind – von Data Governance ist beispielsweise schon seit 25 Jahren die Rede. Viele Unternehmen haben versucht, sie einzuführen und sind mehr oder minder gescheitert, weil es in der Praxis gar nicht so einfach ist, Verantwortung für etwas so Kompliziertes wie ein Datenprodukt zu definieren.

Vor ein paar Jahren haben viele Unternehmen einfach gesagt „Wir brauchen irgendwas mit KI“. Hat sich diese naive Herangehensweise durch den EU AI Act verändert?

Christian Hammer: Die europäische KI-Verordnung zwingt zu einem Umdenken. Dieses „Ich brauche irgendwas mit KI“ funktioniert heute nicht mehr, weil ich als derjenige, der das seinen Kunden oder Mitarbeitenden anbietet, in der Rechenschaftspflicht bin. Ich muss mir Gedanken machen: Was ist das eigentlich? Was steckt da für ein Anwendungsfall drin? Und verbunden mit dem Anwendungsfall: Was steckt da für ein Risiko drin? In dem Moment, wo ich in einer bestimmten Risikoklasse bin, muss ich eine gewisse Transparenz darüber haben. Welche Trainingsdaten sind eingeflossen? Sind sie fair? Ich muss auch meine Entscheidung beziehungsweise den Weg zu meiner Entscheidung transparent machen, damit ein Mensch sie nachvollziehen kann.

Ich nehme an, Sie würden nicht sagen, dass sich Compliance und Innovation bei KI gegenseitig behindern?

Christian Hammer: Genau, das wäre ja schlimm. Ich muss schon einen Rahmen schaffen, aber der Rahmen muss Innovation fördern – so ist ja auch die europäische KI-Verordnung aufgebaut. Ich brauche Inkubatoren, vor allem bei etwas so Schnelllebigem wie der KI oder der generativen KI. Da kann ich nicht so ein starres Regelwerk definieren, dass ich am Ende für jede neue Entwicklung und für jede neue Idee viel länger brauche, um sie an die Kunden beziehungsweise die Mitarbeitenden zu bringen. Wenn die erst nach einem halben Jahr kommt, gibt es schon zwei neue Modelle und vielleicht drei neue Ansätze. KI-Governance ist definitiv auch ein Wettbewerbsvorteil.

Ein bekanntes Problem in Unternehmen ist Shadow-IT. Wie kann KI-Governance beim speziellen Problem der Shadow-KI helfen?

Christian Hammer: Governance schafft zunächst Transparenz darüber, welche Systeme in der Verantwortung der IT existieren. Sie wirkt gesamtheitlich. Auch wenn ich als IT-Abteilung nicht der Betreiber bin, trage ich als IT-Verantwortlicher dennoch die Verantwortung. Es geht auch um die Unternehmenskultur, denn jedes IT-System ist ein potenzieller Einstiegspunkt für Cyberkriminelle. Daher wollen IT-Verantwortliche wissen, was existiert, um es abzusichern.

Aber wie sieht das in der Realität aus? Als Unternehmen kann man die Nutzung privater Dienste kaum kontrollieren, besonders bei Mitarbeitenden im Homeoffice. Ich halte nichts von Überwachung, wie sie einige amerikanische Unternehmen mit Kameras praktizieren. Ich muss mit Vertrauen arbeiten und dieses Vertrauen aktiv aufbauen. Vielleicht muss ich gelegentlich ein Exempel statuieren, wenn mir ein Verstoß bekannt wird, aber eine aktive Kontrolle ist weder praktikabel noch wünschenswert.

Welche konkreten Schulungspflichten sieht der EU AI Act vor und wie sollten Unternehmen diese umsetzen?

Christian Hammer: Seit dem 2. Februar sind Nutzende von KI-Systemen zu schulen. Sie brauchen ein Bewusstsein dafür, was es bedeutet, diese Technologie einzusetzen, mit allen Risiken und Chancen. In der Schulung sollte vermittelt werden, was man tun darf und was nicht, und warum. Dies gilt für alle Mitarbeiter, die mit KI arbeiten, auch wenn sie nur einfache Anwendungen wie das Kürzen von Texten nutzen. Eine 15- bis 20-minütige Basisschulung ist Pflicht. Auch wenn der Invest bei vielen Mitarbeitern beträchtlich sein kann, schafft es einen deutlichen Mehrwert und ein besseres Verständnis für die Technologie.

Wie stehen Sie zu KI-Modellen aus China wie DeepSeek, und wie beeinflusst der schnelle technologische Wandel Ihre Arbeit?

Christian Hammer: Bei chinesischen KI-Modellen wie DeepSeek würde ich erst einmal pragmatisch bleiben. Ähnliche Überlegungen gelten ja auch für Cloud-Dienste und Sprachmodelle aus Amerika. Die entscheidende Frage ist: Was will ich damit machen und welche Daten will ich hineingeben? Es gibt einen Punkt, an dem ich bestimmte Daten nicht mehr in ein externes Modell eingeben kann, weil ich die Herrschaft über die Daten verliere, was rechtlich problematisch sein kann. Aber es gibt Lösungen: Ich kann DeepSeek durchaus lokal, On-premises auf einem kleinen Server in einem abgeschirmten Bereich betreiben und meinem Unternehmen zur Verfügung stellen.

Was den technologischen Wandel betrifft: Es macht die Arbeit herausfordernd, weil Unternehmen viele verschiedene Modelle vorhalten müssen, auf die ein Wirtschaftsprüfer später schauen könnte. IT-Leiter müssen dem zukünftig durch Zentralisierung begegnen. Wenn man immer die neueste Technologie einsetzen will, hat man plötzlich 20 bis 40 Services, die überwacht werden müssen. KI-Modelle verändern sich im Laufe der Zeit, und man muss prüfen, ob sie noch den ursprünglichen Zweck erfüllen. Das überfordert viele IT-Abteilungen, da sie qualitative KPIs aufstellen müssen, um die Treffgenauigkeit und Wertigkeit der Antworten zu messen. Das ist etwas, womit klassische IT bisher nicht konfrontiert war. Vertrieblich ist es für uns interessant, weil wir durch neue Technologien immer neue Impulse setzen können, aber für die Wirtschaft ist es oft ein Albtraum, weil man es managen muss. Und da kommt die KI-Governance ins Spiel.

Vielen Dank für das Gespräch, Herr Hammer!