Die Kapazität von Computerchips ist nahezu ausgereizt, weil die bisher exponentiell gestiegene Leistung von Halbleitern an ihre physikalischen Grenzen stößt. Da man nicht unendlich verkleinern kann, um mehr Performance auf weniger Fläche unterzubringen, werden alternative Technologien entwickelt, wie Quantencomputer und neuromorphe Rechner.

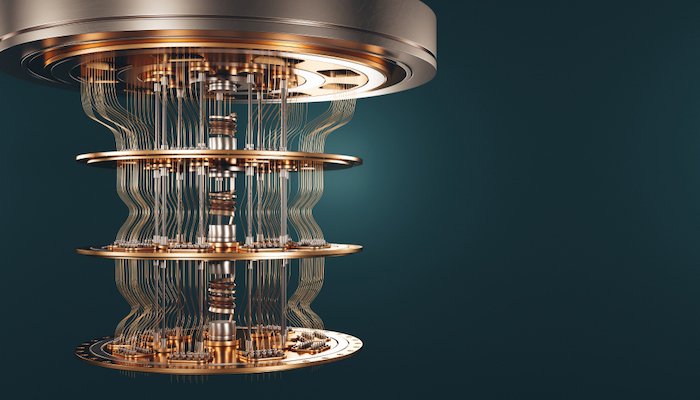

IBM und das Fraunhofer Institut haben am 15. Juni 2021 in Ehningen bei Stuttgart den ersten kommerziellen und bisher leistungsstärksten Quantencomputer Europas vorgestellt: IBM Quantum System One.

Der 3x3x3 Meter fassende Quantencomputer erzielt eine Rechenleistung von 27 Quantenbits (Qubits). Es gibt jedoch außerhalb Europas Quantenrechner mit mehr Leistung, wie z. B. „Eagle“ mit 127 Qubits. Doch was sind Qubits? Diese Frage ist eng mit der grundlegenden Funktionsweise von Quantencomputern verknüpft.

Klassische Rechner mit Von-Neumann-Architektur arbeiten binär, d. h. mit zwei Zuständen: 0 und 1 („Strom fließt nicht“ und „Strom fließt“). Dies wird in der Einheit „Bit“ angegeben. Die physische Umsetzung in Computern besteht aus elektronischen Bauteilen, wie Kondensatoren oder Transistoren in Microchips, wie man es von PCs, Laptops und Servern kennt.

Die zwei elementaren Eigenschaften von Bits sind zum Einen, dass der Wert eines Bits immer eindeutig festgelegt ist und sich durch Messung nicht verändert, und zum Anderen, dass sich der Wert eines Bits nicht sofort ändert, wenn sich der Wert eines anderen Bits geändert hat: erst nach einer gewissen Zeitspanne im Millisekundenbereich kommt die Information der Änderung eines Bitwerts beim anderen Bit an.

Qubits – alles auf einmal

Quantenbits kümmert diese logische Binariät nicht, da ihr Zustand gleichzeitig „0“ und „1“ oder auch viele Zustände dazwischen sein kann. Dadurch werden für Berechnungen wesentlich weniger (Qu)Bits benötigt: 1 Qubit kann z. B. mehrere Zahlen gleichzeitig darstellen, während für eine Zahl schon zwei herkömmliche binäre Bits (0 und 1) benötigt werden. Theoretisch kann mit nur 300 Qubits die unglaubliche Zahl von 3200 dargestellt werden – das ist mehr, als Partikel im Universum existieren! Traditionelle Rechner können dies nicht berechnen. Dass diese Vorgänge mit Überlichtgeschwindigkeit stattfinden, ist ein weiterer Vorteil von Quantencomputern.

Problematisch ist noch die Erzeugung von Quantenbits. Dies erfolgt mit supraleitenden Elementen, „gefangenen“ Ionen bzw. Atomen oder Photonen und anderen Verfahren. Die Ionen werden mit Mikrowellenstrahlung angeregt und so in unterschiedliche Zustände versetzt. Sie können dann mit verschiedenen Informationen geladen werden. Dabei werden die Teilchen jedoch in Bewegung versetzt. Um aber mit den Partikeln arbeiten zu können, müssen sie „ruhiggestellt“ werden. Dies erfolgt mit extremer Kühlung nahe des absoluten Nullpunkts (–273,15 Grad °C) mit aufwändigen Technologien, wie Magnetfeldern und Bose-Einstein-Kondensaten. Außerdem sind Qubits instabil und anfällig gegenüber geringsten Störeinflüssen, wie Erschütterungen sowie magnetischen und elektrischen Feldern und anderen äußeren Faktoren. Quantenphysikalische Praxisanwendungen sind u. a. Solarzellen, MRT, Laser- und Glasfasertechnologie.

Neuromorphe Rechner

Bei dem Interesse an Quantencomputern ist eine anderer Ansatz für neue Rechenarchitekturen in den Hintergrund getreten: neuromorphe Rechner.

Im Gegensatz zum softwarebasierten Ansatz bei Künstlicher Intelligenz verfolgt das neuromorphe Rechnen einen hardwarebasierten Ansatz: das menschliche Gehirn und sein Prinzip der synaptischen Plastizität soll „nachgebaut“ werden. Zwei wesentliche Gründe sprechen dafür: der äußerst geringe Energieverbrauch und die unvergleichbar hohe Rechen- und Speichergeschwindigkeit des Gehirns: Unser Gehirn benötigt im Schnitt 20 Watt Energie und es trennt Informationsverarbeitung und -speicherung räumlich nicht, daher gibt es auch keine durch Übertragungswege und bottlenecks bedingte Latenzen, wie zwischen RAM und CPU klassischer Computerarchitekturen.

Memristoren und optische Mikrokämme

Dies will man mit sog. Memristoren (Memory = Speicher, Resistor = Widerstand) erreichen, denn diese Schaltelemente können Informationen verarbeiten und speichern:

Bei Memristoren wird der Widerstand, d. h. die Leitfähigkeit durch angelegte Spannung verändert, wobei der letzte Widerstandswert auch nach Abschalten der Spannung beibehalten wird. Dies ist möglich, weil geladene Atome aufgrund von Spannungsunterschieden zwischen zwei Elektroden wandern und sich ablagern: der Widerstand an einer Stelle wird erhöht bzw. verringert. Dies entspricht im Grunde dem biologischen Prinzip der synaptischen Plastizität: Synapsen leiten bestimmte Signale stärker weiter, wenn die Synapsen in schneller Folge wiederholt erregt werden: die Verbindungen zwischen Neuronen werden anatomisch-physisch verstärkt. Dieser Prozess ist auch umkehrbar, wenn die entsprechenden Reize wieder nachlassen (Lernen und Vergessen). Memristoren ahmen dies nach, d. h. sie sind nicht absolut bzw. starr, sondern können sich anpassen, sie sind quasi lernfähig! Für die technologische Umsetzung dieses Wirkprinzip gibt es verschiedene Ansätze, doch bedürfen sie noch wesentlicher Verbesserungen. So können die Memristoren bisher nur auf herkömmliche binäre Weise verwendet werden. In Zukunft soll dies analog wie im Gehirn erfolgen, d. h., dass die Memristoren mehrere Zustände haben und zusätzliche Funktionen übernehmen können.

Eine andere Herangehensweise wird an der Swinburne University of Technology (Melbourne, Australien) in Kooperation mit der Monash University in Melbourne sowie dem Institut National de la Recherche Scientifique in Kanada, Hongkong und China verfolgt, wo der „weltweit schnellste und leistungsfähigste optische neuromorphe Prozessor“ für KI vorgestellt wurde. Projektleiter Prof. David Moss sagt, dass der Chip auf sog. optischen Mikrokämmen aufgebaut ist, die 10 Billionen Operationen pro Sekunde ausführen können – dies ist ca. 1.000 Mal schneller als bisherige Prozessoren. So können z. B. [System-]Uhren in Smartphones möglich werden, die so präzise wie die besten Uhren der Welt sind, und Dinge erkennen können, wie die gravitative Rotverschiebung einer Person in der Nähe. Damit wären zum Beispiel Global Positioning Systeme (GPS) überflüssig, weil jeder seine eigene Uhr und seinen eigenen Bewegungssensor hätte.