In der modernen Unternehmenswelt fließen gewaltige Summen in den Aufbau hochmoderner Dateninfrastrukturen. Doch hinter den glänzenden Fassaden aus Cloud-Speichern und Analyse-Tools stellt sich oft die ernüchternde Frage: Wie hoch ist die Dateneffizienz 2026 wirklich?

Ohne präzise Messgrößen bleibt die Antwort meist im Bereich der Spekulation. Experten wie die von Denodo weisen in diesem Zusammenhang darauf hin, dass Dateneffizienz kein abstrakter IT-Begriff ist, sondern das Fundament für den geschäftlichen Erfolg bildet.

Die Messbarkeit des Erfolgs: Zentrale KPIs für die Datenarchitektur

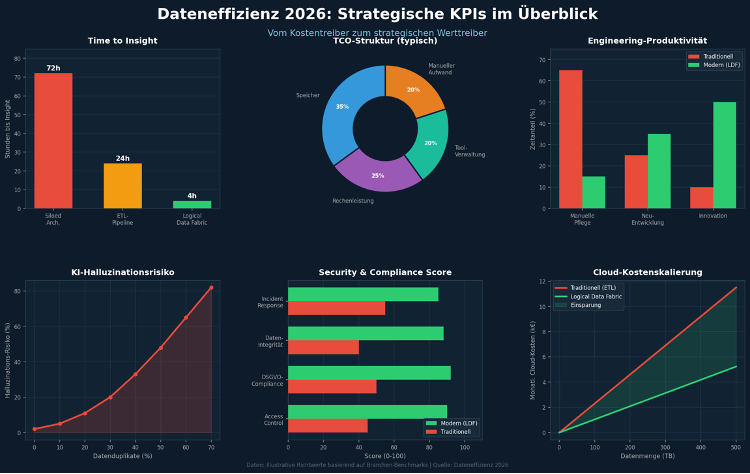

Um Licht in das Dunkel der Datenkosten zu bringen, müssen Unternehmen von vagen Schätzungen zu belastbaren Kennzahlen übergehen. Nur wer misst, wie Daten fließen und wo sie stagnieren, kann den Hebel an der richtigen Stelle ansetzen. Dabei geht es nicht nur um technische Parameter, sondern um Kennzahlen, die unmittelbar den Geschäftserfolg widerspiegeln. Die vier zentralen KPIs sind: Time to Insight, Engineering-Produktivität, Data Quality Score (DQS) sowie Pipeline Reliability & Verfügbarkeit.

Time to Insight: Geschwindigkeit als Wettbewerbsvorteil

Ein zentraler Indikator für diesen Erfolg ist die sogenannte Time to Insight. Sie beschreibt die Zeitspanne, die verstreicht, bis aus strukturierten und unstrukturierten Rohdaten eine solide Entscheidungsgrundlage für den operativen Betrieb oder strategische KI-Anwendungen wird. Wenn Daten in isolierten Silos liegen und Architekturen fragmentiert sind, führt dies zwangsläufig zu Verzögerungen.

Unternehmen müssen dann Daten massiv replizieren oder komplexe Integrationsschichten manuell pflegen, was Innovationen bremst und den Vorsprung gegenüber agileren Wettbewerbern schrumpfen lässt. Die Messung ist dabei denkbar simpel: Es zählt allein die Zeit, die vergeht, bis ein Endnutzer ein fertiges Analysemodell oder Dashboard nutzen kann.

Engineering-Produktivität und Kostentransparenz (TCO)

Parallel dazu offenbart sich die Dateneffizienz einer Infrastruktur in der Produktivität des Data Engineering. Ein hoher manueller Aufwand für die Justierung von Prozessen deutet meist auf doppelte Pipelines und eine geringe Wiederverwertungsquote hin. Anstatt neuen Wert zu schöpfen, verbringen Experten ihre Zeit mit der Wartung starrer Systeme. Um die Kosteneffektivität wirklich zu durchdringen, reicht ein Blick auf die reinen Anschaffungskosten nicht aus.

Erst die Berechnung der Total Cost of Ownership (TCO), die Rechenleistung, Speicher, Toolverwaltung und Personalkosten einbezieht, macht die Skalierbarkeit transparent. In einer Welt, die sich durch regulatorische Vorgaben und dynamische Märkte ständig wandelt, wird zudem die Agilität zur Überlebensfrage.

Data Quality Score (DQS): Messbarkeit der Datenqualität

Ein oft vernachlässigter, aber kritischer KPI ist der Data Quality Score (DQS). Er erfasst den Anteil der Datensätze, die definierte Qualitätskriterien erfüllen – darunter Vollständigkeit, Aktualität, Konsistenz und Eindeutigkeit. Branchen-Benchmarks zeigen, dass Unternehmen mit einem DQS unter 80 % bis zu 30 % ihrer Data-Engineering-Kapazität für die nachträgliche Datenbereinigung aufwenden müssen. Ein kontinuierliches DQS-Monitoring ist daher eine Voraussetzung, um KI-Modelle mit verlässlichen Trainingsdaten zu versorgen und fehlerhafte Entscheidungen zu vermeiden.

Pipeline Reliability & Verfügbarkeit: Das operative Rückgrat

Eng damit verknüpft ist die Pipeline Reliability, also die Zuverlässigkeit und Verfügbarkeit von Datenpipelines. Ausfälle oder verzögerte Datenlieferungen führen direkt zu gestörten Geschäftsprozessen und erhöhen den manuellen Korrekturaufwand erheblich. Ein SLA-konformer Betrieb mit klaren Schwellenwerten für Latenzen und Fehlerquoten ist deshalb integraler Bestandteil einer reifen Datenstrategie. Moderne Observability-Tools wie Monte Carlo Data oder Great Expectations ermöglichen proaktives Monitoring und verkürzen die mittlere Wiederherstellungszeit (MTTR) signifikant.

Strategische Rentabilität: Der ROI der Dateneffizienz

Um die theoretischen Vorteile in eine betriebswirtschaftliche Realität zu übersetzen, verdeutlicht ein Blick auf die Total Cost of Ownership (TCO) das enorme Einsparpotenzial. Ein typisches Unternehmen, das bisher auf starre, manuelle ETL-Pipelines und physische Datenreplikation setzte, sieht sich oft mit einer Kostenstruktur konfrontiert, bei der allein 35 % des Budgets in Speicher und 20 % in manuellen Wartungsaufwand fließen. Durch den Umstieg auf eine Logical Data Fabric lassen sich diese „stillen Kosten“ massiv reduzieren.

In einem realistischen Szenario für das Jahr 2026 führt die Implementierung einer logischen Schicht zu einer Reduktion des Engineering-Aufwands um etwa 40 %, da Experten weniger Zeit mit der Reparatur fragmentierter Pipelines und mehr mit wertschöpfenden Innovationen verbringen können. Hinzu kommt eine signifikante Senkung der Cloud-Gebühren: Durch intelligente Deduplikation und den Verzicht auf unnötige Datenbewegungen lassen sich die Infrastrukturkosten für Speicher und Rechenleistung um bis zu 30 % optimieren.

Besonders eindrucksvoll zeigt sich der Return on Investment bei der Time to Insight. Während traditionelle Silo-Architekturen oft Tage benötigen, um Daten entscheidungsreif aufzubereiten, verkürzt die logische Abstraktion diesen Prozess auf wenige Stunden. Wenn man diese gewonnene Agilität und die vermiedenen Kosten für KI-Fehlentscheidungen durch schlechte Datenqualität (DQS) gegen die Lizenz- und Einführungskosten aufrechnet, erreichen viele Unternehmen bereits im ersten Jahr einen positiven ROI, der sich in den Folgejahren durch wegfallende Implementierungskosten weiter steigert. Die Berechnungen basieren auf Branchen-Benchmarks von Analysten wie Gartner und BARC sowie dem „Total Economic Impact (TEI) “-Framework von Forrester Research. Nach deren Forschung zu Data Virtualization, so die Denodo-Experten, zeigt sich eine 83% Reduktion der Time-to-Revenue und 65% geringere Delivery-Zeiten gegenüber ETL.

Sicherheit und Sauberkeit: Die unsichtbaren Säulen der Effizienz

Die rein betriebswirtschaftliche Betrachtung greift jedoch zu kurz, wenn man die modernen Herausforderungen der IT-Sicherheit und Daten-Deduplikation ignoriert. Effizienz bedeutet heute auch, die Integrität und den Schutz der Informationen sicherzustellen, da jeder Sicherheitsvorfall die mühsam gewonnenen Effizienzvorteile sofort zunichtemacht.

Security by Design: Risikominimierung durch zentrale Governance

Ein effizientes System minimiert die Angriffsfläche. Durch die Reduzierung unnötiger Datenkopien sinkt nicht nur der Speicherbedarf, sondern auch das Risiko für Sicherheitslecks an vergessenen Speicherorten. Eine logische Datenschicht ermöglicht es hierbei, Sicherheitsrichtlinien zentral zu steuern. Anstatt Berechtigungen mühsam in jedem einzelnen Quellsystem zu implementieren, wird eine einheitliche Governance über alle Datenströme hinweg gelegt. Dies schützt sensible Informationen und vereinfacht die Einhaltung strenger Compliance-Vorgaben wie der DSGVO massiv.

Daten-Deduplikation: Effiziente Ressourcennutzung ohne Daten-Müll

Gleichzeitig bekämpft die Deduplikation den wachsenden „Daten-Müll“. In vielen Unternehmen existieren identische Datensätze in zigfacher Ausführung auf unterschiedlichen Servern. Durch intelligente Deduplikations-Verfahren werden diese Dubletten identifiziert und durch eindeutige Referenzen (Pointer) ersetzt, sodass die Daten nur einmal physisch gespeichert werden. Dies senkt nicht nur die Cloud-Speicherkosten drastisch, sondern schont auch die Rechenpower bei Suchanfragen. Ein schlankes Datensystem ist schneller, kostengünstiger und leichter zu verwalten.

Die KI-Falle: Warum Dateneffizienz über den Erfolg von Machine Learning entscheidet

Besonders kritisch wird das Thema Dateneffizienz im Kontext von Künstlicher Intelligenz. Viele Unternehmen stürzen sich auf Generative AI, vergessen dabei aber die Qualität ihrer Datenbasis. Werden KI-Modelle mit inkonsistenten Informationen aus verschiedenen Quellen gefüttert, führt dies zwangsläufig zu fehlerhaften Ergebnissen oder sogenannten „Halluzinationen“.

Dateneffizienz fungiert hier als Qualitätsfilter: Sie stellt sicher, dass KI-Agenten nur auf die „Single Source of Truth“ zugreifen – ein Prinzip, das insbesondere bei RAG-Architekturen (Retrieval-Augmented Generation) entscheidend ist, da hier die Qualität der abgerufenen Dokumente direkt die Antwortgüte des Modells bestimmt. Zudem droht ohne effiziente Datenabfragen eine Kostenexplosion: Ineffiziente Abfrage-Algorithmen von KI-Systemen können die Cloud-Gebühren innerhalb kürzester Zeit unkontrolliert in die Höhe treiben.