Die digitale Infrastruktur wächst exponentiell und Unternehmen verlieren zunehmend die Kontrolle über ihre Systeme. Observability wird zu einem entscheidenden Instrument, das nicht nur Ausfälle verhindert, sondern den Weg für autonome KI-Agenten und echte Unternehmensresilienz ebnet.

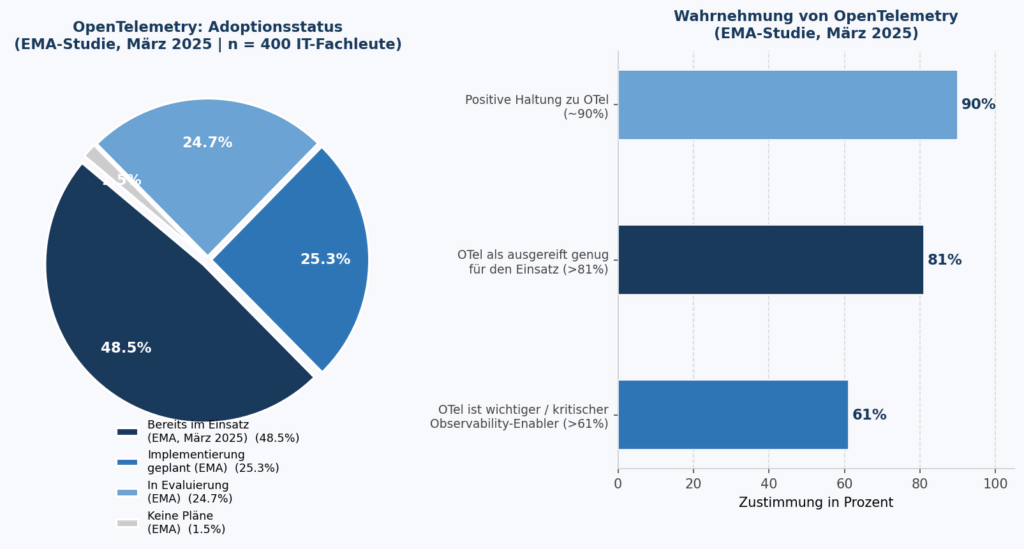

TL;DR – Das Wichtigste auf einen Blick ✔ Observability ist kein IT-Tool mehr – es ist eine strategische Plattformentscheidung auf C-Level. ✔ Alert-Fatigue kostet Unternehmen real Geld: 91% verlieren >300.000 USD/Stunde bei Ausfällen (ITIC 2024). ✔ OpenTelemetry ist der gesetzte Standard: 48,5% nutzen ihn produktiv, 75% sind kurz davor oder mittendrin (EMA, März 2025). ✔ KI-Agenten scheitern ohne saubere Observability-Basis – nicht umgekehrt. ✔ Marktführer laut Gartner MQ 2025: Dynatrace, Datadog, Splunk, New Relic, Elastic, Grafana Labs, IBM Instana. ✔ Deutschland ist europäischer Vorreiter bei OTel-Adoption (Splunk-Lagebericht, Feb. 2026). |

Die IT-Infrastruktur moderner Unternehmen wächst in einer Geschwindigkeit, die klassische Monitoring-Ansätze systematisch überfordert. Microservices, Multi-Cloud-Architekturen, KI-gestützte Anwendungen und ein explodierendes Datenvolumen schaffen eine Komplexität, bei der traditionelle Dashboards und regelbasierte Schwellenwert-Alarme schlicht nicht mehr ausreichen. Was Entscheider, IT-Leiter und CIOs heute brauchen, ist kein besseres Monitoring – sondern Observability: die Fähigkeit, das Innenleben ihrer Systeme vollständig zu verstehen, bevor Probleme zum Ausfall führen.

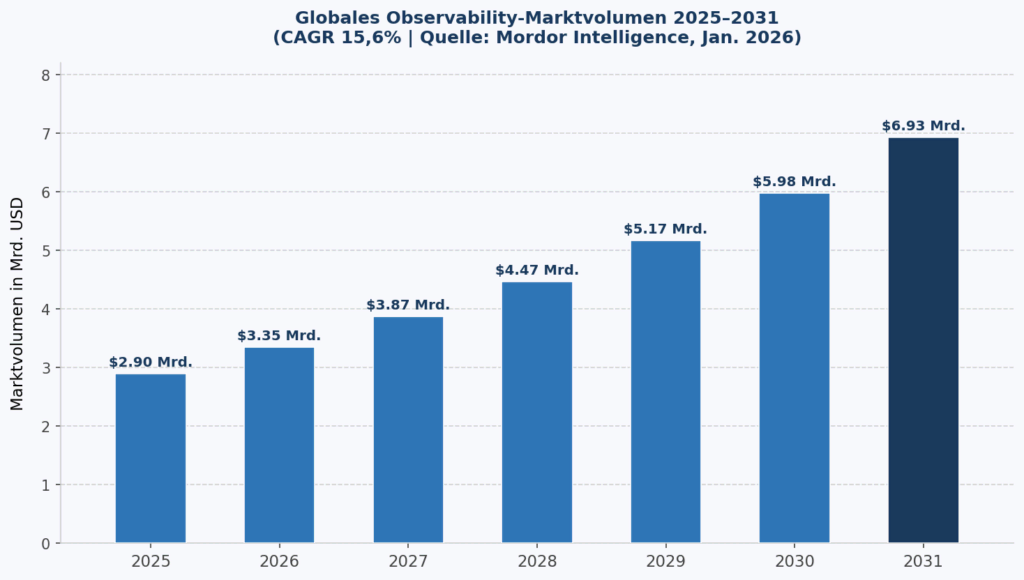

Der Markt hat diese Verschiebung bereits eingepreist. Laut Mordor Intelligence belief sich das globale Observability-Marktvolumen im Jahr 2025 auf 2,9 Milliarden US-Dollar und soll bis 2031 auf 6,93 Milliarden US-Dollar anwachsen – einer jährlichen Wachstumsrate (CAGR) von 15,6 Prozent (Quelle: Mordor Intelligence Observability Market Report, Januar 2026). Rechnet man das breitere Segment aller Observability Tools & Platforms hinzu, kommen andere Marktforscher auf deutlich größere Volumina, was zeigt, wie dynamisch dieses Segment noch ist. Klar ist: Observability entwickelt sich zu einem strategischen Frühwarnsystem für Unternehmensentscheidungen.

Von Monitoring zu Observability: Was den Unterschied macht

Traditionelles Monitoring beantwortet die Frage: „Ist das System oben oder unten?” Observability beantwortet: „Warum verhält sich das System so, wie es sich verhält?” Diese semantische Verschiebung ist tiefgreifend. Gartner definiert Observability-Plattformen als Systeme, die durch die Aufnahme von Telemetriedaten – Logs, Metriken, Events und Traces – Veränderungen im Systemverhalten erkennen, die sich auf die Endnutzer-Erfahrung auswirken, und eine frühzeitige oder sogar präventive Problembehebung ermöglichen (Quelle: Gartner, Market Guide for Data Observability Tools, Februar 2026).

Dieser Ansatz basiert auf den drei Säulen: Metriken liefern quantitative Momentaufnahmen – CPU-Auslastung, Request-Raten, Fehlerquoten. Logs dokumentieren Ereignisse in Textform. Traces verfolgen einzelne Anfragen durch verteilte Systeme und machen nachvollziehbar, welcher Microservice, welche Datenbank oder welche externe API für einen Engpass verantwortlich ist. Erst im Zusammenspiel entsteht das vollständige Lagebild, das moderne Cloud-native IT-Umgebungen erfordern.

Wie tief dieser Wandel bereits reicht: Laut dem Gartner 2025 State of AI-Ready Data Survey haben 53 Prozent der Data- und AI-Führungskräfte bereits Observability-Tools implementiert – weitere 43 Prozent planen dies innerhalb der nächsten 18 Monate. Der Markt für Data Observability wuchs 2024 um 20,8 Prozent auf 346,4 Millionen US-Dollar (Quelle: Gartner Market Share Analysis, zitiert im Gartner Market Guide for Data Observability Tools, Februar 2026).

Deutschland: Europäischer Vorreiter bei Observability

Besonders positiv aus DACH-Perspektive: Deutschland nimmt international eine führende Rolle bei der Einführung von Observability-Ansätzen und der Adoption von OpenTelemetry ein. Das geht aus dem Observability-Lagebericht von Splunk hervor, über den it-daily.net ausführlich berichtete. Wo OpenTelemetry eingesetzt wird, berichten viele Organisationen von messbaren wirtschaftlichen Effekten – offene Telemetrie schafft also nicht nur technische Transparenz, sondern messbaren Geschäftswert.

Beim praktischen Nutzen stehen laut Splunk-Bericht zwei Bereiche im Vordergrund: das Monitoring kritischer Geschäftsprozesse sowie die frühzeitige Erkennung von Bedrohungen und Schwachstellen. Ein wachsender Anteil der befragten Unternehmen betrachtet Observability und Security nicht mehr als getrennte Disziplinen, sondern als zwei Seiten derselben Medaille – eine Entwicklung, die auch den internen Budget- und Zuständigkeitsfragen eine neue Richtung gibt.

Alert-Fatigue: Das unterschätzte Geschäftsrisiko

Paradoxerweise birgt bessere Observability auch ein neues Risiko: Enterprise-Umgebungen können täglich mehr als 10.000 Alarme generieren. Nach einer Analyse von 9,6 Millionen jährlichen Observability-Events werden weniger als 18 Prozent der Warnungen tatsächlich bearbeitet. Dieses Phänomen – Alert-Fatigue oder Warnmüdigkeit – ist zu einem zentralen Unternehmensrisiko geworden.

Laut einer Umfrage unter IT-Führungskräften ab VP-Ebene geben 36 Prozent an, durch eine Flut von Benachrichtigungen an eigentlichen Problemen vorbeizuarbeiten. Die finanziellen Konsequenzen: 91 Prozent der mittelgroßen und großen Unternehmen verlieren mehr als 300.000 US-Dollar pro Stunde während eines Ausfalls; bei 41 Prozent liegt dieser Wert zwischen einer Million und fünf Millionen US-Dollar pro Stunde (Quelle: ITIC 2024 Hourly Cost of Downtime Survey).

Forrester-Analysten haben ermittelt, dass Unternehmen mit KI-gestützten Observability-Plattformen eine Rendite von 274 Prozent über drei Jahre erzielen – mit einer Amortisationszeit von unter sechs Monaten (Quelle: Forrester Research, zitiert in ViB Community Report, Dezember 2025). Damit ist die Investment-Entscheidung für Observability kein reines IT-Budget-Thema mehr, sondern eine Frage der Unternehmensresilienz.

OpenTelemetry: Der gesetzte Standard für Cloud-native Telemetrie

Der wichtigste technische Durchbruch der vergangenen zwei Jahre trägt den Namen OpenTelemetry (OTel). Das quelloffene CNCF-Projekt liefert ein herstellerneutrales Framework zur standardisierten Erfassung und Übertragung von Telemetriedaten – Metriken, Logs und Traces. Das Prinzip: „Einmal instrumentieren, überall exportieren.” it-daily.net hat diese Revolution ausführlich beleuchtet.

Die Adoptionszahlen sind eindeutig: 48,5 Prozent der Unternehmen nutzen OpenTelemetry bereits produktiv, weitere 25,3 Prozent planen die Implementierung. Knapp 75 Prozent befinden sich also auf dem OTel-Weg – nur 1,5 Prozent haben keinerlei Pläne (Quelle: EMA/Elastic Report: Taking Observability to the Next Level, März 2025). Mehr als 61 Prozent bezeichnen OTel als wichtigen oder kritischen Observability-Enabler. Auch der CNCF Annual Survey 2025 bestätigt: Rund 49 Prozent der befragten Cloud-Native-Unternehmen haben OpenTelemetry adoptiert – das meistgenutzte noch nicht vollständig graduierte CNCF-Projekt (Quelle: CNCF Annual Survey 2025, Januar 2026).

Fast die Hälfte (46 Prozent) der Unternehmen, die OTel produktiv einsetzen, berichten von mehr als 20 Prozent ROI; weitere 40 Prozent erzielen 10 bis 20 Prozent ROI (Quelle: EMA-Studie, März 2025). Für Unternehmen, die heute Observability-Plattformen evaluieren, gilt: OpenTelemetry ist kein Nice-to-have, sondern eine strategische Minimalanforderung – und der wirksamste Schutz gegen Vendor Lock-in.

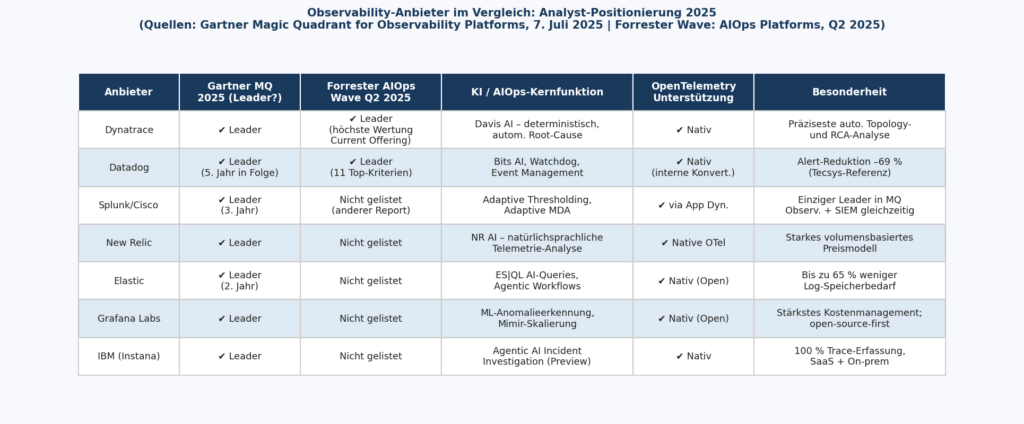

Marktführer im Überblick: Gartner und Forrester im Vergleich

Der Observability-Plattformmarkt ist intensiv umkämpft. Im Gartner Magic Quadrant for Observability Platforms 2025 (7. Juli 2025) wurden 20 Anbieter evaluiert – sieben wurden als Leader eingestuft: Dynatrace, Datadog, Splunk, New Relic, Elastic, Grafana Labs und IBM (Instana). Der Forrester Wave: AIOps Platforms Q2 2025 (April 2025) beurteilte 10 Anbieter anhand von 26 Kriterien.

Dynatrace

Dynatrace gilt als Benchmark für KI-gestützte Observability. Im Forrester Wave AIOps Q2 2025 erhielt das Unternehmen die höchste Gesamtbewertung im Bereich „Current Offering” unter allen zehn evaluierten Anbietern sowie Bestnoten in 17 von 26 Kriterien, darunter Log-Management, datengetriebene Automatisierung und Preistransparenz (Quelle: Forrester Wave: AIOps Platforms, Q2 2025). Die Davis AI Engine liefert deterministische Root-Cause-Analysen ohne manuelle Regelkonfiguration.

Datadog

Datadog wurde zum fünften Mal in Folge als Leader im Gartner Magic Quadrant gelistet (Quelle: Gartner MQ, 7. Juli 2025) und im Forrester AIOps Wave mit Höchstnoten in elf Kriterien ausgezeichnet, darunter Innovation, Log-Management und Incident-Erkennung. Praxisbeispiel: Bei Tecsys sank die Zahl der Alert-Incidents durch Datadogs Event Management um 69 Prozent (Quelle: Datadog/Tecsys-Referenz, zitiert im Forrester AIOps-Bericht).

Splunk / Cisco

Splunk ist zum dritten Mal in Folge Leader im Gartner MQ for Observability Platforms – und als einziger Anbieter gleichzeitig für das zehnte Mal in Folge Leader im Gartner MQ for SIEM (Quelle: Splunk Pressemitteilung, Juli 2025). Die Kombination aus Splunk Observability Cloud, AppDynamics und ThousandEyes ergibt eine der breitesten Plattformen am Markt.

New Relic, Elastic, Grafana Labs, IBM Instana

Alle vier wurden ebenfalls als Leader im Gartner Magic Quadrant 2025 gelistet. IBM Instana erfasst 100 Prozent aller Traces in Echtzeit und bietet echte Feature-Parität zwischen SaaS und On-Premises. Elastic reduziert den Log-Speicherbedarf durch den neuen logsdb Index-Mode um bis zu 65 Prozent. Grafana Labs führt beim offenen Kostenmanagement und hat das breiteste Deployment-Netzwerk im Open-Source-Segment (Quelle: Gartner MQ for Observability Platforms, 7. Juli 2025).

KI als Game-Changer: Von AIOps zu Agentic Observability

84 Prozent der Unternehmen erkundeten oder pilotierten 2025 KI in der Observability (Quelle: APMdigest, 2026 Observability Predictions). it-daily.net machte im Mai 2025 auf eine besonders wichtige Konsequenz aufmerksam: KI-Agenten benötigen eine transparente Infrastruktur als Voraussetzung. Autonome KI-Agenten können nur dann verlässlich agieren, wenn die Datenqualität der darunterliegenden Systeme sauber und konsistent ist.

Gartner betont: Semantic Drift Monitoring – die Erkennung subtiler Bedeutungsverschiebungen in Daten – wird zur kritischen Anforderung, bevor KI-Modelle auf diesen Daten agieren (Quelle: Gartner, Market Guide for Data Observability Tools, Februar 2026). Schlechte Telemetriedaten in Agentic-AI-Szenarien erzeugen nicht nur fehlerhafte Berichte – sie können autonome Agenten dazu verleiten, falsche Aktionen durchzuführen. In der Logistik bedeutet das konkret: fehlerhafte Routenoptimierung oder gestörte Lagerautomation mit direkten Betriebsfolgen.

KI-Initiativen scheitern nicht an der KI selbst, sondern an mangelhafter Systemüberwachung – das war das Kernergebnis eines weiteren it-daily.net-Beitrags. Bis 2028 wird laut Gartner ein Drittel aller Generative-AI-Interaktionen autonome Agenten einbeziehen. Observability folgt: Agenten untersuchen Incidents eigenständig, fassen Kontext zusammen und initiieren Lösungen – bevor ein Mensch ein Dashboard öffnet.

Analysten-Konsens: Was Gartner, Forrester und EMA empfehlen

Forrester beschreibt in „The State of AIOps and Observability” den Übergang von reaktivem Monitoring zu proaktiver Orchestrierung als Kernaufgabe für IT-Führungskräfte. Hybride Cloud-Umgebungen erzeugen Datenvolumina, die ohne KI nicht mehr beherrschbar sind. Forrester betont neben nativem Telemetrie-Zugang auch kosteneffiziente Implementierungsansätze – ein Hinweis darauf, dass Total-Cost-Modellierung bei konsumptionsbasierten Preismodellen entscheidend wird.

Gartner sieht die Zukunft der Observability in vollständiger AIOps-Integration: Deterministische KI analysiert Service-Abhängigkeiten, ML treibt Anomalieerkennung und prädiktive Alarmierung an, selbstheilende Workflows übernehmen Routineaufgaben (Quelle: Gartner, zitiert in Network World, August 2025). Die EMA urteilt: OpenTelemetry wird zum Wettbewerbsvorteil in den meisten Branchen. IBM-Analysten sehen für 2026 drei Kerntrends: intelligentere KI-Plattformen, Observability als FinOps-Baustein und beschleunigte OTel-Adoption (Quelle: IBM Think Insights, Januar 2026).

Handlungsempfehlungen für Entscheider

- OpenTelemetry als strategischen Nicht-Verhandelbar-Standard definieren. Proprietäre Instrumentierung heute bedeutet Migrationskosten morgen.

- Alert-Fatigue als KPI messen: Alarme pro Woche, False-Positive-Rate, Bearbeitungsquote. Was nicht gemessen wird, wird nicht verbessert.

- Observability und Security Teams strukturell verzahnen – kombinierte Teams zeigen laut Splunk-Daten die stärksten Ergebnisse.

- KI-Initiativen mit einer Observability-Readiness-Prüfung beginnen: Schlechte Telemetriedaten sind der häufigste Grund für KI-Scheitern in der Produktion.

- Total Cost of Ownership (TCO) modellieren – besonders bei konsumptionsbasierten Preismodellen können KI-Workloads Kosten unvorhergesehen skalieren.

Fazit: Observability als Frühwarnsystem für die Unternehmensführung

Observability hat den Status eines reinen IT-Tools längst hinter sich gelassen. In einer Welt, in der KI-Agenten autonome Entscheidungen auf Basis von Systemdaten treffen, ist die Qualität der Observability-Infrastruktur direkt mit der Verlässlichkeit von Geschäftsprozessen verknüpft. Alert-Fatigue bedroht nicht nur On-Call-Teams – sie bedroht die Verfügbarkeit kritischer Dienste und damit den Unternehmenserfolg. OpenTelemetry schafft die neutrale Grundlage, auf der Unternehmen frei und ohne Lock-in-Risiko wählen können.

Der Markt wächst, die Technologie reift – und Deutschland spielt eine führende europäische Rolle. Die eigentliche Herausforderung liegt weniger in der Tool-Auswahl als im organisatorischen Wandel: Observability funktioniert als strategisches Frühwarnsystem nur, wenn die richtigen Menschen auf das reagieren, was es sichtbar macht. Klare Verantwortlichkeiten, priorisierte Warnmeldungen und eine Unternehmenskultur, die Transparenz als Vorteil begreift – das ist die eigentliche Hausaufgabe.

FAQ: Häufig gestellte Fragen zu Observability

Was ist Observability – einfach erklärt?

Observability bezeichnet die Fähigkeit, den internen Zustand eines IT-Systems allein durch die Analyse seiner externen Ausgaben zu verstehen: Metriken (Zahlen), Logs (Ereignistexte) und Traces (Anfrage-Pfade). Im Gegensatz zum klassischen Monitoring, das vorher definierte Schwellenwerte überwacht, erlaubt Observability auch die Diagnose unbekannter, bisher nicht gesehener Probleme – ein entscheidender Vorteil in komplexen Cloud-Umgebungen.

Was ist der Unterschied zwischen Monitoring und Observability?

Monitoring prüft bekannte Metriken gegen vordefinierte Grenzwerte (“Ist der Server unter 90 % CPU?”). Observability ermöglicht dagegen explorative Diagnose: “Warum ist diese API-Response langsam – und welche Microservices, Datenbankabfragen und Netzwerkaufrufe sind kausal beteiligt?” Observability umfasst Monitoring, geht aber weit darüber hinaus. Gartner spricht von der Fähigkeit zur “präventiven Problembehebung”.

Was ist OpenTelemetry und warum ist es wichtig?

OpenTelemetry (OTel) ist ein quelloffener CNCF-Standard zur herstellerneutralen Erfassung und Übertragung von Telemetriedaten (Metriken, Logs, Traces). Wichtig: Es verhindert Vendor Lock-in. Wer OTel nutzt, kann seinen Observability-Backend (Dynatrace, Datadog, Grafana etc.) wechseln, ohne die gesamte Instrumentierung im Code neu schreiben zu müssen. Laut EMA nutzen 48,5 % der Unternehmen OTel bereits produktiv (Stand: März 2025).

Was ist Alert-Fatigue und welche Folgen hat es?

Alert-Fatigue (Warnmüdigkeit) bezeichnet den Zustand, in dem IT-Teams durch eine Überflutung mit Alarmen – oft tausende täglich – abstumpfen und kritische Warnungen ignorieren oder übersehen. Laut ViB Community werden weniger als 18 % aller Observability-Events tatsächlich bearbeitet. Die Folge: echte Incidents werden zu spät erkannt. Abhilfe schaffen KI-gestützte Korrelation, Deduplizierung und intelligentes Alerting.

Welche Observability-Tools sind laut Gartner führend?

Im Gartner Magic Quadrant for Observability Platforms 2025 (7. Juli 2025) wurden sieben Anbieter als Leader eingestuft: Dynatrace, Datadog, Splunk (Cisco), New Relic, Elastic, Grafana Labs und IBM (Instana). Im Forrester Wave: AIOps Platforms Q2 2025 führen Dynatrace (höchste Gesamtbewertung) und Datadog (Leader in 11 Kriterien).

Warum ist Observability eine Voraussetzung für KI-Agenten?

Autonome KI-Agenten treffen Entscheidungen auf Basis von Systemdaten. Sind diese Daten unvollständig, veraltet oder inkonsistent, führen Agenten falsche Aktionen aus – und zwar automatisch und in großem Maßstab. Gartner bezeichnet “Semantic Drift Monitoring” als kritische Anforderung für den KI-Einsatz. Ohne saubere Observability-Basis kein zuverlässiger KI-Betrieb.

Wie groß ist der globale Observability-Markt 2025?

Laut Mordor Intelligence (Januar 2026) beträgt das Marktvolumen für Observability-Plattformen 2025 rund 2,9 Milliarden US-Dollar und wächst bis 2031 auf 6,93 Milliarden USD (CAGR 15,6 %). Bei breiterem Marktschnitt (alle Tools & Platforms) kommen andere Analysten auf größere Volumina. Gartner beziffert das Wachstum im Segment Infrastructure Observability Software auf 12 % CAGR bis 2027.