Emojis im Quellcode sind kein Qualitätsmerkmal. Bei der Hackergruppe APT36 sind sie es trotzdem, als unfreiwilliger Beweis dafür, dass hier kein Mensch, sondern ein Sprachmodell die Finger im Spiel hatte.

Die vom pakistanischen Staat unterstützte Gruppe, auch bekannt als Transparent Tribe, entwickelt ihre Malware inzwischen mit KI-Unterstützung. Bitdefender Labs hat die Schadsoftware analysiert und stellt die naheliegende Frage: Wie gut ist das eigentlich? Die kurze Antwort: nicht besonders. Die längere Antwort: gut genug.

Syntaktisch korrekt, logisch löchrig

Der von KI erzeugte Code wird in der Szene „Vibeware“ genannt, in Anlehnung an das Prinzip des Vibe Codings, bei dem Entwickler Anforderungen eintippen und die Ausgabe kaum noch verstehen oder prüfen. Er ist formal in Ordnung, logisch hingegen weist er regelmäßig Mängel auf. Teile der Malware funktionieren schlicht nicht. Wer gehofft hatte, KI würde die nächste Generation staatlicher Cyberangriffe unbrauchbar machen, wird allerdings enttäuscht: Der Großteil der Schadsoftware ist trotzdem funktionsfähig. Für APT36 ist das ausreichend. Die Strategie lautet nicht Präzision, sondern Volumen.

Masse schlägt Klasse

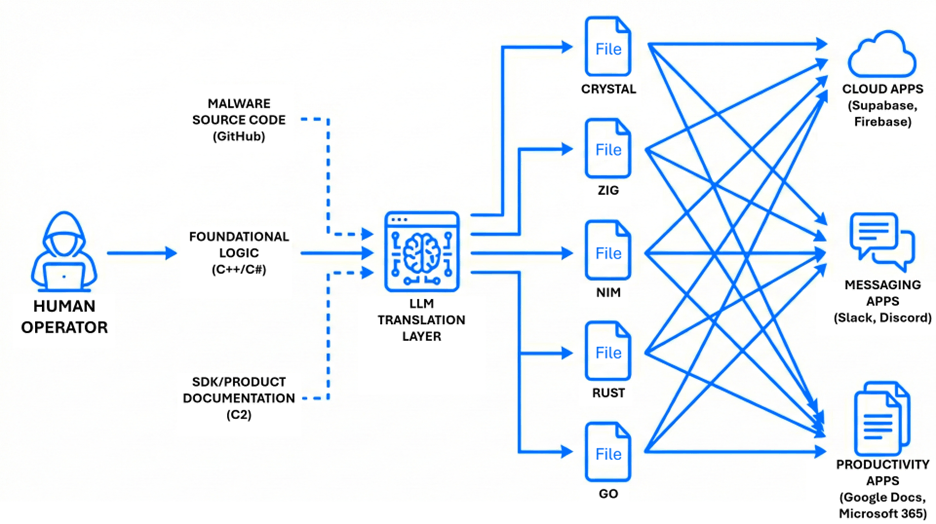

Statt weniger, hochentwickelter Werkzeuge fluten die Angreifer ihre Ziele mit automatisiert generierten Schadprogrammen über mehrere Kanäle und Sprachen gleichzeitig. Wird ein Angriffsweg geblockt, läuft ein anderer weiter. Bitdefender nennt das „Distributed Denial of Detection“: Die Abwehr wird nicht durch Raffinesse überwunden, sondern durch schiere Menge erschöpft.

Das funktioniert besonders gut, wenn die Malware in Programmiersprachen geschrieben ist, die Sicherheitslösungen kaum kennen. APT36 setzt dafür auf Nischensprachen wie Nim, Zig oder Crystal. Die meisten Erkennungssysteme sind auf Verhaltensprofile für Code in .NET, C# oder C++ trainiert. Exotischerer Code fällt schlicht durchs Raster. Dank Sprachmodellen müssen die Angreifer diese Sprachen nicht mehr beherrschen, sondern nur noch abfragen. Und bei Bedarf wechseln sie einfach zur nächsten.

Legitime Dienste als Tarnkappe

Neben der Sprachvielfalt macht sich APT36 einen weiteren Vorteil zunutze: Wer über Slack, Discord oder Google Sheets kommuniziert, fällt in den meisten Unternehmensnetzen nicht auf. Die Gruppe nutzt genau diese Dienste. Google Sheets dient zur Steuerung der Malware, Firebase und Supabase zur Datenspeicherung, Slack und Discord zur Kommandoübermittlung und Datenexfiltration, Azure Front Door zur Verschleierung. Living Off Trusted Services nennt sich das Prinzip, kurz LOTS. Der Datenverkehr gilt als legitim, wird selten gefiltert, und die nötige Implementierung liefert das Sprachmodell gleich mit.

Gut genug für wen?

Die Ziele sind bekannt: indische Regierungsstellen, Militär, diplomatische Einrichtungen, Rüstungsumfeld. Der Einstieg erfolgt klassisch über infizierte Mail-Anhänge. Neu ist nicht das Ziel, sondern das Tempo. Was früher spezialisiertes Können erforderte, lässt sich heute in industriellen Mengen automatisieren. Vibeware ist keine Kunst. Aber Cyberangriffe müssen keine Kunst sein. Sie müssen nur oft genug funktionieren.