Mehrere Computer auf einem Rechner: Virtuelle Maschinen sind das Rückgrat von Cloud und Rechenzentren. Doch wie funktioniert die Technologie, welche Anbeiter gibt es und warum bleibt sie trotz Container-Konkurrenz unverzichtbar?

Inhalt

Das macht eine Virtual Machine

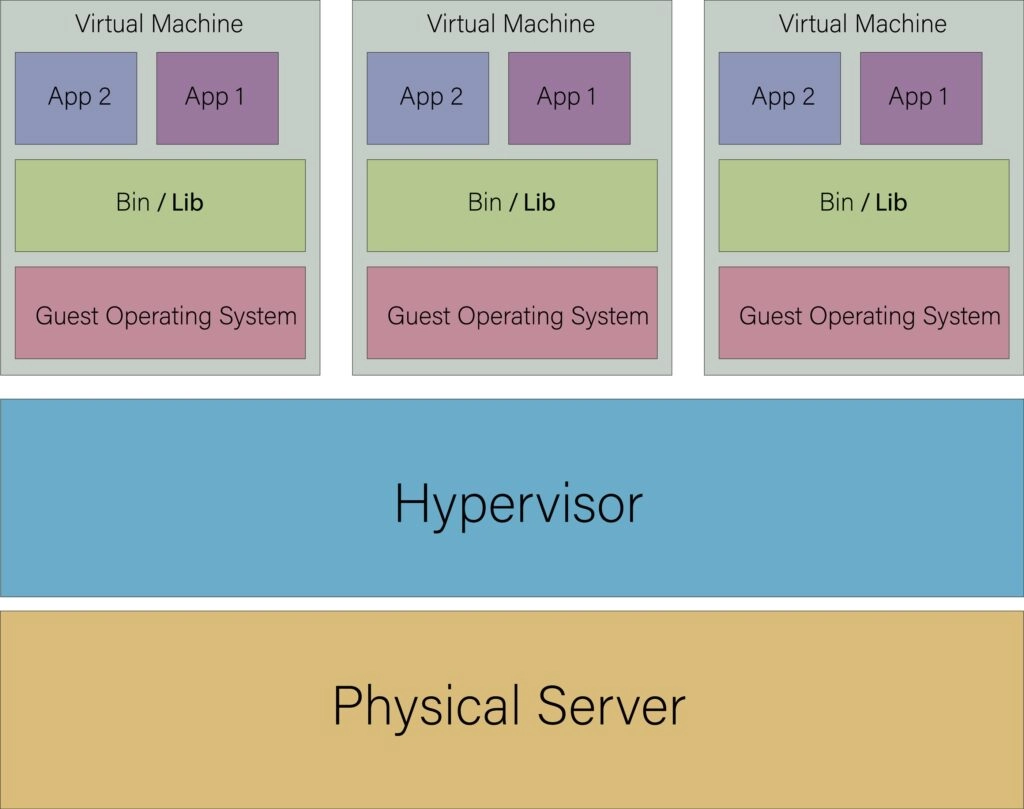

Eine Virtual Machine, kurz VM, ist im Grunde ein softwarebasierter Computer innerhalb eines physischen Computers. Sie emuliert die Hardware eines Systems so vollständig, dass darauf ein eigenständiges Betriebssystem installiert und betrieben werden kann. Für Anwendungen verhält sich eine VM wie ein physischer Rechner, auch wenn moderne Betriebssysteme erkennen können, dass sie virtualisiert laufen.

Virtualisierung trennt die Software von der darunterliegenden Hardware. Diese Abstraktionsschicht schafft enorme Flexibilität. Ressourcen lassen sich dynamisch zuweisen, Systeme können im laufenden Betrieb zwischen Servern verschoben werden und unterschiedliche Betriebssysteme laufen parallel auf derselben Maschine.

Der eigentliche Vorteil liegt in der effizienten Ressourcenverteilung. Ein moderner Server mit 64 CPU-Kernen und 512 Gigabyte RAM würde bei vielen Workloads stark unterausgelastet bleiben. Virtuelle Maschinen ermöglichen es, diese Ressourcen auf zahlreiche kleinere Systeme aufzuteilen und die Hardware deutlich effizienter zu nutzen.

Hypervisor: Das Herzstück der Virtualisierung

Zentrale Komponente jeder Virtualisierungslösung ist der Hypervisor, auch Virtual Machine Monitor genannt. Diese Software verwaltet die Virtual Machine und vermittelt zwischen den Gast-Systemen und der physischen Hardware.

Man unterscheidet zwei grundlegende Architekturen.

Typ-1-Hypervisor, auch Bare-Metal-Hypervisor genannt, laufen direkt auf der Hardware ohne darunterliegendes Betriebssystem. Sie sind in Enterprise-Umgebungen Standard, da sie besonders effizient arbeiten und die Hardware-Virtualisierungsfunktionen moderner CPUs direkt nutzen können. In professionellen Rechenzentren und Cloud-Umgebungen kommen fast ausschließlich Typ-1-Hypervisor zum Einsatz.

Typ-2-Hypervisor sind Anwendungen, die auf einem herkömmlichen Betriebssystem installiert werden. Sie eignen sich vor allem für Entwickler und Power-User, die auf ihrem Desktop zusätzliche Betriebssysteme betreiben möchten. Durch die zusätzliche Softwareschicht kann etwas Performance verloren gehen, wobei moderne Implementierungen in vielen Szenarien sehr nahe an Typ-1-Lösungen heranreichen.

Hardware-Unterstützung als Schlüssel

Moderne Virtualisierung wäre ohne spezielle CPU-Features kaum praktikabel. Intel VT-x und AMD-V erweitern die Prozessorarchitektur um Funktionen, die es ermöglichen, dass Gast-Betriebssysteme viele Befehle direkt auf der CPU ausführen können, ohne dass der Hypervisor permanent eingreifen muss. Das reduziert den Overhead erheblich.

Auch bei der Speicherverwaltung helfen Hardware-Features. Intel Extended Page Tables und AMD Rapid Virtualization Indexing beschleunigen die Übersetzung zwischen virtuellen und physischen Speicheradressen. Ohne diese Technologien müsste der Hypervisor deutlich häufiger vermitteln, was spürbare Performanceeinbußen verursachen würde.

Für GPU-intensive Anwendungen existieren ebenfalls Virtualisierungslösungen. Technologien wie GPU-Passthrough oder Multi-Instance-GPU erlauben es, eine physische Grafikkarte entweder direkt einer VM zuzuweisen oder sie auf mehrere VMs aufzuteilen. Damit sind auch grafikintensive Workloads in virtuellen Umgebungen realisierbar.

Einsatz in Rechenzentren und Cloud

In Rechenzentren ist Servervirtualisierung seit Jahren Standard. Statt für jeden Dienst einen eigenen physischen Server bereitzustellen, laufen zahlreiche VMs auf wenigen leistungsstarken Maschinen. Das spart Hardwarekosten, Energie und Stellfläche. Verwaltungsaufwände sinken, da VMs sich per Software klonen, verschieben und sichern lassen.

Die Cloud-Computing-Revolution basiert fundamental auf Virtualisierung. Große Public-Cloud-Anbieter betreiben massiv skalierte Virtualisierungsinfrastrukturen, um Kunden isolierte Rechenressourcen bereitzustellen. Eine typische Cloud-Instanz entspricht technisch einer VM auf einem geteilten physischen Server. Moderne Architekturen lagern viele Virtualisierungsfunktionen zusätzlich in dedizierte Hardware aus, um Performance und Sicherheit weiter zu verbessern.

Entwickler nutzen virtuelle Maschinen häufig für Testumgebungen. Eine frische Linux-Installation lässt sich in Minuten starten und nach Abschluss der Tests wieder löschen. Snapshots erlauben es, einen bestimmten Systemzustand zu konservieren und bei Bedarf wiederherzustellen. Das ist ideal für Softwaretests und Experimente.

Auch für Sicherheit und Isolation sind VMs wertvoll. Potenziell gefährliche Software lässt sich in einer VM ausführen, ohne das Host-System direkt zu gefährden. Malware-Analysten verwendenVirtual Machines routinemäßig, um Schadsoftware in kontrollierter Umgebung zu untersuchen.

Was sind die bekanntesten Anbieter?

Im Enterprise-Bereich dominiert seit vielen Jahren VMware mit seiner vSphere-Plattform. Sie bietet Funktionen wie Live-Migration, Hochverfügbarkeit und automatische Lastverteilung. Veränderungen im Lizenzmodell haben zuletzt allerdings zu Diskussionen im Markt geführt.

Microsoft Hyper-V ist fest in Windows Server integriert und eine naheliegende Wahl für Unternehmen mit starker Microsoft-Infrastruktur. Die Lösung ist ausgereift und lässt sich eng mit Active Directory und anderen Microsoft-Diensten verzahnen.

Im Open-Source-Umfeld hat sich KVM als Standard unter Linux etabliert. KVM ist direkt im Linux-Kernel integriert und bildet die Basis vieler Virtualisierungslösungen. Auch große Cloud-Anbieter setzen auf KVM-basierte Architekturen, häufig ergänzt durch eigene Hardware-Erweiterungen.

Für Desktop-Virtualisierung sind Lösungen wie VirtualBox, VMware Workstation oder Parallels Desktop verbreitet. Sie ermöglichen es, mehrere Betriebssysteme parallel auf einem Arbeitsplatzrechner zu betreiben.

Xen zählt zu den ältesten Open-Source-Hypervisoren und wird weiterhin in spezialisierten Umgebungen eingesetzt. QEMU wiederum ist ein vielseitiger Emulator und Virtualisierer, der häufig in Kombination mit KVM genutzt wird und verschiedene Prozessorarchitekturen emulieren kann.

Container als Ergänzung

In den letzten Jahren haben Container-Technologien an Bedeutung gewonnen. Container teilen sich den Kernel des Host-Betriebssystems und virtualisieren nur die darüberliegenden Schichten. Dadurch sind sie schlanker und starten deutlich schneller als klassische VMs.

Allerdings ist die Isolation bei Containern geringer, da alle Container auf einem Host denselben Kernel nutzen. Zudem benötigen Linux-Container unter Windows eine zusätzliche Virtualisierungsschicht wie WSL2 oder Hyper-V.

Für viele moderne Anwendungen, insbesondere Microservices, sind Container ideal. Wenn vollständige Betriebssystem-Instanzen, Legacy-Anwendungen oder besonders strikte Isolation erforderlich sind, bleiben VMs unverzichtbar. In der Praxis werden beide Technologien häufig kombiniert, indem Container innerhalb virtueller Maschinen betrieben werden.

Performance und Overhead

Der Performance-Overhead moderner Virtualisierung ist vergleichsweise gering. Bei CPU-lastigen Workloads erreichen VMs oft sehr nahe an nativer Performance. Abweichungen hängen jedoch stark vom jeweiligen Workload ab.

Kritischer ist die I/O-Performance. Festplatten- und Netzwerkzugriffe durchlaufen zusätzliche Software-Schichten, was Latenz verursachen kann. Deshalb nutzen moderne Hypervisor para-virtualisierte Treiber, die speziell für virtuelle Umgebungen optimiert sind.

Ein weiterer Faktor ist der Speicherverbrauch. Jede VM benötigt RAM für ihr eigenes Betriebssystem. Mehrere VMs verbrauchen daher deutlich mehr Speicher als mehrere Container. Techniken wie Memory Deduplication können identische Speicherseiten zusammenfassen und so Ressourcen sparen, werden jedoch aus Sicherheitsgründen nicht immer uneingeschränkt eingesetzt.

Zukunft der Virtualisierung

Die Entwicklung geht in Richtung stärkerer Hardware-Unterstützung und höherer Sicherheit. Technologien wie AMD SEV oder Intel TDX ermöglichen es, komplette virtuelle Maschinen kryptografisch zu isolieren, sodass selbst der Hypervisor keinen direkten Zugriff auf deren Speicherinhalte erhält.

Unikernel-Konzepte verfolgen einen anderen Ansatz. Sie kombinieren Anwendung und minimalen Betriebssystemkern zu einem stark spezialisierten System, das sehr schlank ist und dennoch die Isolation virtueller Maschinen nutzt.

Fazit

Eins ist sicher: Virtual Machines haben die IT-Landschaft verändert. Sie ermöglichen effizientere Hardware-Nutzung, flexible Infrastrukturen und das Geschäftsmodell moderner Cloud-Anbieter. Trotz der Konkurrenz durch Container bleiben VMs ein zentrales Werkzeug, insbesondere wenn vollständige Isolation oder unterschiedliche Betriebssysteme erforderlich sind. Die Technologie ist ausgereift, entwickelt sich jedoch kontinuierlich weiter, vor allem im Hinblick auf Sicherheit und Performance.