Fachbeitrag aus der IT Management 03/04 1994:

Die Begriffe „Downsizing“ und „Client/Server“ haben wie Zauberformeln auf die von hohen IV-Kosten geplagten Unternehmen gewirkt. Die schon lange gehegte Hoffnung auf eine billigere und effizientere Datenverarbeitung scheint endlich Wirklichkeit zu werden.

Der Gedanke, wie DV-Ressourcen zu verteilen seien, ist ja keinesfalls neu. Man denke nur an das Schlagwort DDP (Distributed Data Processing), das in den beginnenden 80er Jahren in den Unternehmen der Branche einigen Staub aufgewirbelt hat. Damals traten revoltierende Fachabteilungen auf den Plan, die es gewagt hatten, an der professionellen DV vorbei mit Hilfe der IBM /38 eigene Wege zu gehen. Auch damals wurden die Argumente „Kosten“ und „Effizienz“ in die Waagschalte geworfen. Welche Gründe auch immer den Ausschlag gaben: Die Palastrevolution wurde verhindert, und das Thema DDP was lange Zeit tabu. Jetzt ist es unter anderen Namen auf der Tagesordnung, und zwar präsenter und mit besseren Argumenten als je zuvor.

Rezessionszeiten

In den Zeiten der Rezession muss an allen Ecken und Enden gespart werden. So ist es nicht verwunderlich, dass vor allem nach Kosten gefragt und mit Kosten argumentiert wird. Erst recht in der Datenverarbeitung – hier ist man sich schon seit geraumer Zeit im Klaren, dass man dem immer schlechter werdenden Wirkungsgrad ein Ende setzen muss.

Deshalb stellt sich dieser Beitrag das Ziel, die Kostenfrage realistisch und differenziert zu betrachten. Um die Klarheit der Aussachen nicht zu verwässern, wird zunächst auf Nutzenaspekte verzichtet.

Man braucht sich nicht in ausschweifenden Überlegungen zu ergehen, um zu dem Ergebnis zu kommen, dass es eine allgemeingültige Antwort auf die Frage „Was kosten Client/Server wirklich?“ nicht geben kann. Die Ausgangssituation der Unternehmen ist höchst unterschiedlich. Es ist ja nicht egal, ob sich ein klassischer Mainframer Schritt für Schritt in eine Client/Server-Umgebung bewegt oder ob sich ein mittelständisches Unternehmen „von unten“ eine Client/Server-Landschaft aufbaut. Das Bild des klassischen Mainframers, leicht überzeichnet:

- In den Rechenzentren stehen mehrere IBM- oder IBM-kompatible Großrechner, beherrscht und behütet von über hundert Programmierern und Systemprogrammierern.

- Im Unternehmen verstreut gibt es Hunderte bis Tausende PC, deren Betrieb meist noch unorganisiert, spielerisch oder gar nicht stattfindet.

- Die DV-Mitarbeiter sind konventionell ausgebildet (COBOL, MVS, VSAM, IMS, DB2) und den überwiegenden Teil ihrer Zeit mit Wartung beschäftigt.

- Es gibt eine Unzahl (zwei- bis dreitausend oder mehr) seit 20 oder 30 Jahren gewachsener unüberschaubarer, permanent pflegebedürftiger Programme.

- Die Fachabteilungen sind unzufrieden. Das Schlagwort vom „Anwendungsstau“ wird nicht altmodisch.

- Zentrale DV und IDV sind verfeindet oder leben irgendwie nebeneinander her.

- Die Kosten steigen von Jahr zu Jahr, der Unmut der Fachabteilungen weicht der Resignation.

Mit Blick auf die Kosten ist vor allem die Frage zu beantworten: Wie ist die Kostensituation in der Zeit der Koexistenz, wenn es die Mainframes weiterhin gibt und die professionell eingesetzten PC dazukommen?

Ferner sei davon ausgegangen, dass der Downsizing-Prozess gewollt ist sowie vorangetrieben werden soll und nicht etwa dem organischen Wachstum folgt.

Kosten „on top“

Stellen wir uns einen Mainframer vor, der ab jetzt alle neuen Anwendungen aus Client/Server-Basis realisieren möchte. Eine erste Anwendung von der Qualität und Größenordnung einer kompletten Warenwirtschaft stehe ins Haus. Das Unternehmen habe mehrere weitgehend autonom agierende Filialen uns möchte die Möglichkeiten der Vor-Ort-Intelligenz voll ausschöpfen. Es mögen rund 300 Anwender betroffen sein.

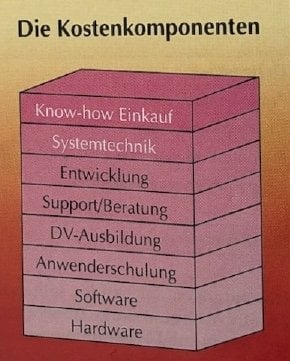

Wir betrachten und untergliedern diejenigen Kosten, die zu echten Ausgaben führen:

Hardware

In den nächsten drei Jahren sind etwa 300 PC für Entwickler und Anwender auf den neuesten Stand zu bringen oder zu ersetzen. Mag es noch angehen, dass ein isoliert arbeitender Sachbearbeiter, der nur eine ältere Textverarbeitung nutzt, mit einem 286er auskommt und seine Disketten zum Drucken ins Nachbarzimmer bringt – als aktiver Teilnehmer eines Clients/Server-Netzes, das eine strategische Anwendung trägt, ist diese Umgebung unbrauchbar.

Die initialen Kosten für Workstations sind auf mindestens 5000 Mark x 300, also auf 1,5 Millionen Mark anzusetzen. Gehen wir davon aus, dass die Netze eine durchschnittliche Größe von 20 Benutzern haben, so entstehen Kosten für 15 Netze. Pro Server (Rechner, Drucker, Streamer, USV und dergleichen) rechnen wir 25 000 bis 30 000 Mark, insgesamt also 375 000 bis 450 000 Mark. Für die Wartung sind in den drei Jahren 500 bis 600 Mark pro Gerät, insgesamt also 157 000 Mark bis 189 000 Mark zu kalkulieren.

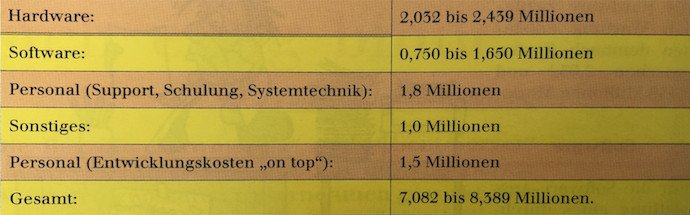

Für Hardware zuzüglich Wartung entstehen demnach Kosten zwischen 2,032 und 2,439 Millionen Mark.

Software

Für die Software-Ausstattung eines durchschnittlichen PC (mittlerer Leistungsbedarf, Markengerät) sind 1000 Mark bis 2000 Mark Initialausstattung und (in drei Jahren) 1000 Mark bis 2000 Mark für Upgrades realistische Größen; für einen Server schlagen Initialausstattung und Updates mit jeweils 5000 Mark bis 15 000 Mark zu Buche.

Für Software ergibt sich in den ersten drei Jahren also ein Kostenblock von 750 000 bis 1 650 000 Mark.

Personal

Der Betrieb einer professionellen Client/Server-Landschaft erfordert eine ebenso professionelle Support-Mannschaft, die den Anwender bei akut auftretenden Problemen unterstützen kann. Erfahrungsgemäß benötigen 300 Anwender zwei Vollzeit-Support-Kräfte. In unserem Beispiel etwa 200 000 Mark pro Jahr, in drei Jahren also 600 000 Mark.

Für die Ausbildung der Anwender und für die systemtechnischen Aufgaben müssen mindestens jeweils zwei Vollzeitkräfte eingesetzt werden. An Personalkosten entstehen also in drei Jahren rund 1,8 Millionen Mark.

Sonstiges

Für Schulungsräume (eigene oder fremde), ergänzende Ausbildung bei externen Anbietern, Personalbereitstellung, Reisen und Material rechnen wir noch pauschal 1 000 000 Mark.

Die Systementwicklung muss ebenfalls in die Kalkulation einbezogen werde, selbst wenn sie „sowieso“, dass heißt, sonst im konventionellen Umfeld stattfinden würde. Korrekterweise sind hier nur diejenigen Kosten zu berücksichtigen, die anfallen, weil es nicht die konventionelle Umgebung ist.

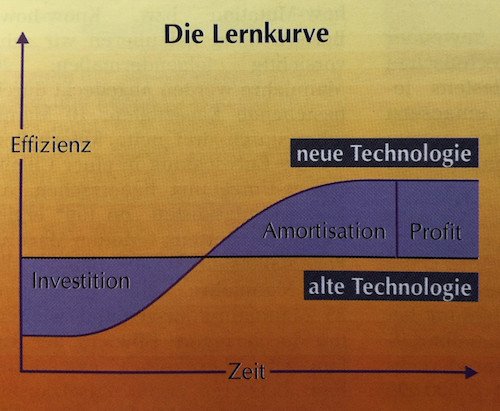

Eine Anwendung, die das gesamte operationale Geschehen eines Unternehmens abbildet, schlägt im Falle einer Eigenentwicklung mit mindestens 30 Mannjahren zu Bucht. Wir müssen davon ausgehen, dass die bestehende Mannschaft aus Kapazitäts- und Know-how-Gründen nicht in der Lage ist, die Entwicklung zu leisten. Die Kapazitätsgründe dürfen hier nicht berücksichtigt werden, da sie auch beim konventionellen Vorgehen gelten würden. Für die Know-how-Bereitstellung kalkulieren wie sehr vorsichtig folgendermaßen: 20 Mannjahre werden abgedeckt durch bestehende Kapazitäten, 10 Mannajahre durch drei neue Mitarbeiter, die die Entwicklung in einer Client/Server-Umgebung beherrschen. An Entwicklungskosten „on top“ ergibt sich so mindestens 1 Millionen Mark an Personalkosten; ferner müssen die 20 Mannjahre aus mindestens 25 Mannjahre ausgedehnt werden, um die geringe Effizienz der Anfangszeit (Lernkurve) einzubeziehen. Letzteres ergibt Zusatzkosen von rund 500 000 Mark.

Insgesamt haben wir also in den ersten drei Jahren für eine Großanwendung mit 300 Anwendern folgendes Kostenbild:

Bisher lag ein Planungshorizont von drei Jahren zugrunde (drei Jahre sind etwa der Innovationszyklus bei Hard- und Software). Zur Vervollständigung der Betrachtung muss die Entwicklung der nächsten Planungszeiträume angeschlossen werden. Wie die obige Argumentation zeigt, werden Software- und Hardwarekosten nach drei Jahren in voller Höhe wieder anfallen. Die Personalkosten kalkulieren wir sehr optimistisch mit Nullwachstum. Wir gehen davon aus, dass nun eine spürbare Entlastung der Mainfrage-Umgebung evident wird. Leider wird das nicht kostenwirksam, sondern es entsteht das Phänomen brachliegender Ressourcen.

Wenn es nun gelingt, die freigewordenen Ressourcen anderweitig zu nutzen, so entstehen für die Entwicklung neuer Anwendungen nicht zwingend Personalkosten, wohl aber weitere Ausgaben für Hard- und Software sowie für Ausbildung, Support und Reisen. Anhand der oben dargestellten Basiszahlen kann der Leser die Kalkulation für sich selber, auf seine Situation angewandt, weiterführen.

Als Conclusio sei folgende Überlegung erlaubt:

Die Zusatzkosen sind allemal so hoch, dass derjenige, der nur Kosten- und Rationalisierungsaspekte verfolgt, argumentativ einen schweren Stand hat. Die obige Betrachtung ist optimistisch und berücksichtigt keine Turbulenzen, ist also als Minimalkalkulation zu verstehen.

Jedes sich der Planung entziehende chaotische Ereignis führt eine rein kostenbasierte Argumentation ad absurdum. Auf eine Formel gebracht: Die Kostenargumentation ist weder dazu geeignet, den Innovationsschritt Client/Server zu tun, noch ihn zu unterlassen.

„Downsizing“ der Kostenfrage

„Alles fließt“, jener berühmte Ausspruch des altgriechischen Philosophen Heraklit, ist noch immer richtig – und keine Kostenbetrachtung der Welt kann eine mächtige, den Zeitgeist prägende Entwicklung bremsen, es bleibt zu untersuchen, ob es sich im Falle Client/Server um eine solche Jahrhundertbewegung handelt oder ob die so oft irregeführten Datenverarbeiter wieder einmal einer Modewelle folgen.

Megatrends

Ein wirklich „großer“ Trend zeichnet sich unter anderem dadurch aus, dass es viele zusammenwirkende Ursachen für sein Zustandekommen gibt. Wer die Tageszeitung studiert, wird unablässig auf die Schlagworte „Lean Management“, „Überalterung“ und „Standort Deutschland“ stoßen. Deren Zusammenhand mit der Client/Server-Bewegung ist schnell hergestellt:

„Lean Management“ bedeutet unter anderem, dass hierarchische Führungsstrukturen zugunsten leistungsfähiger, autark agierender Teams „aufgeweicht“ werden müssen.

Solche Leistungsträger sind mit Kompetenz und Technik auszustatten, die ein von einer realen oder fiktiven „Zentrale“ unabhängiges, reaktionsschnelles Handeln ermöglichen. Sie technische Lösung dazu kann weder zentralistisch noch schwerfällig, noch unmodern sein.

Auch die Frage, wie immer weniger junge Menschen immer mehr alte Menschen ausreichend ernähren sollen, kann nur auf eine Weise beantwortet werden: durch den Einsatz leistungsfähiger Technologien – wo immer es geht, so gut es geht und so billig es geht.

Es muss nicht mehr deduziert werden, sondern es ist an der Realität abzulesen: Die heute vorherrschenden Mainframe-Strukturen erfüllen diesen Anspruch nicht. Sie sind zwar nicht Ursache für die „Verkrustungsphänomene“, aber sie sind deren Bestandteil. Der mit Client/Server eingeleitete oder einzuleitende Innovationschritt ist nicht alleinseligmachend, aber eine notwendige flankierende Maßnahme zur Auflösung starrer Unternehmensstrukturen, die den Standort Deutschland unattraktiv und träge machen.

DV als Allgemeingut

Ein wesentliches unterstützendes Moment kommt noch dazu: Wir erleben derzeit, dass die Daten und ihre verantwortliche Verarbeitung den rechtmäßigen Besitzern zurückgegeben werden. Datenverarbeitung wird Allgemeingut. Genauso wenig wie es heute noch professionelle Schriftgelehrte geben muss, wird es in (längerer) Zukunft noch viele professionelle Datenverarbeiter geben.

Ein Blick auf Kinder und Jugendliche bestätigt dies. Kleinkinder wachsen mit dem Computer auf. Er wird sie mir Sicherheit ins Berufs- und Privatleben begleiten. Es ist nicht vorstellbar, dass eine Rückdelegation an eine „Zentrale“ stattfinden kann.

Dem Leser sei es erspart, eine Diskussion über Unternehmensziele und Nutzen zu führen; denn weder Kosten noch kurzfristige Nutzenbetrachtungen können eine starke Entwicklung ernsthaft beeinflussen – und was die Ziele angeht: Ziel eines jeden Unternehmens muss es sein, nicht dem Gorbatschow-Ausspruch zum Opfer zu fallen und wegen „Zuspätkommens vom Leben bestraft“ zu werden.

Von Gundela Schimmig, Fachbeitrag IT Management 03/04 1994

Happy Bithday it management!