Betrachtet man die Entwicklung beim Bestreben der Hersteller die Datendichte von Festplatten zu erhöhen, so lässt sich feststellen, dass es in den letzten Jahren zwar gelungen ist die Dichte zu erhöhen, jedoch die Flächen eines Schreib-/ Lesekopfes hierbei im Verhältnis zur Datendichte nur marginal reduziert wurden. Hierdurch entstehen zukünftige Herausforderungen bei der Datenwiederherstellung für Labore und Anwender, warnen die Experten der KUERT Datenrettung Deutschland GmbH in Bochum.

Höhere Datendichte in Festplatten stellt neue Herausforderungen für Anwender und Datenrettung dar

Für die Datenrettung ist dies ein Problem, denn mit steigender Datendichte wird im Falle eines Headcrashs der Festplatte auch eine höhere Anzahl an Sektoren irreparabel beschädigt, die in diesen in diesen beschädigten Bereichen liegen.

Studien des Herstellers Hitachi / HGST belegen zudem eine Korrelation zwischen fortschreitender Miniaturisierung und der durchschnittlichen Lebensdauer von Festplatten:

Je kleiner die Festplatten Bauform, desto kürzer der Lebenszyklus (Quelle: Hitachi HGST @2014):

5.25″ 15-20 Jahre

3.5″ 10-20 Jahre

2.5″ 10 Jahre

Was bedeutet das für den Anwender?

Für den Anwender bedeutet es sich genau vor Augen zu halten, wofür er Festplatten einsetzen will, welche Daten er darauf speichern will und diesen Daten einen Wert beizumessen:

- Sind die Daten ersetzlich oder unersetzlich ?

“Im Falle unersetzlicher Daten sollte jeder Anwender sich vor Augen halten, dass herstellerseitige Marketingversprechen zur Lebensdauer von Festplatten keine Garantie für die Ausfallsicherheit einer Festplatte darstellen. Hier gilt, dass jeder selbst zusehen muss wo er bleibt und für sich die ideale und bestenfalls automatisierte Lösung sucht, um diese unersetzlichen Daten regelmäßig auf verschiedenen Speicherorten und Speicherarten abzulegen”, sagt Martin Eschenberg, CMO bei KUERT Datenrettung in Bochum.

Zukunftsausblick zur Datenrettung hochkapazitärer Festplatten im Labor

Je höher die Datendichte einer ausgefallenen Festplatte ist, desto höher ist auch der anzusetzende Arbeits- und Zeitaufwand. Die Datendichte steht hierbei in einer direkten Korrelation zum jeweiligen Fehler und natürlich auch den entsprechenden Kosten zur Datenrettung sowie dem Erfolg der Rettung. Und sie steht auch, so man den Hitachi-Zahlen glauben schenken möchte, in einer direkten Beziehung zur Lebensdauer einer Festplatte.

Doch wie definiert sich “Erfolg” für Rettungslabore?

Rettungslabore definieren Erfolg oder Erfolgsquoten unterschiedlich. So finden sich Aussagen wie “99 % Erfolgsquote”, jedoch ohne hierauf einen speziellen Bezug zum Medium, zur Kundenzufriedenheit oder zur Anzahl zu nehmen.

Labore, die es etwas kundenfreundlicher und transparenter gestalten, definieren ihren “Erfolg” im Sinne von durch den Kunden angenommene Datenrettungsfälle. Also dessen, dass gerettet wurde was der Kunde haben auch gerettet haben wollte. Dass die Quoten hierbei naturgemäß deutlich niedriger, aber natürlich auch realistischer sind, versteht sich von selbst.

Die Angabe von Erfolgsquoten ist ein Marketingmerkmal, denn retten kann man in den meisten Fällen etwas, selbst dann wenn es nur zwei unstrukturierte Zeilen eines Windows-Ereignisprotokolls sind, zwar ist dies dann aus Sicht des Kunden ein Misserfolg, aus Sicht des Marketings betreffender Labore jedoch ein Erfolg, wenn auch schöngerechnet.

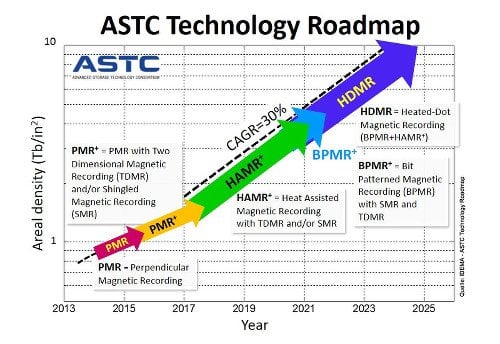

Neue Festplatten-Technologien ante Portas

Zukünftige Festplattengenerationen beinhalten Technologien wie HAMR, MAMR oder TDMR und stellen neue Herausforderungen für Labore dar, die es zunächst einmal allesamt in den Griff zu kriegen gilt. Folgt man jedoch den Entwicklungen der letzten Jahre so werden auch zukünftig die gleichen Mechanismen und Korrelationen greifen wie in der Vergangenheit. Für die Anwender sollte zukünftig, entgegen aller Technologie, die Backup-Disziplin und der persönliche Backup-Plan die allerhöchste Prämisse haben. Denn jede physikalische Beschädigung einer Plattenoberfläche steht zukünftig in einem direkten Zusammenhang mit der Datendichte pro Scheibe, stärker noch als dies in den vorausgegangenen Jahren noch der Fall war.